溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

本篇內容介紹了“如何啟動Spark集群”的有關知識,在實際案例的操作過程中,不少人都會遇到這樣的困境,接下來就讓小編帶領大家學習一下如何處理這些情況吧!希望大家仔細閱讀,能夠學有所成!

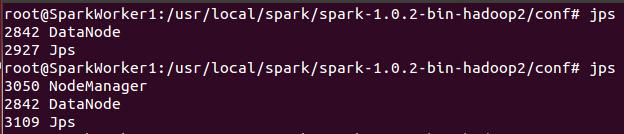

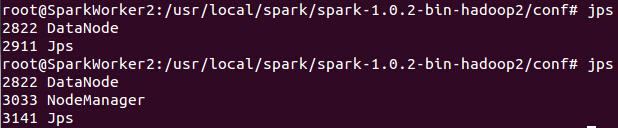

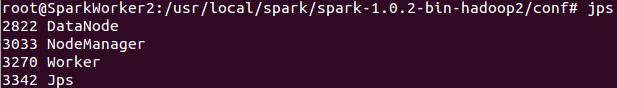

在SparkWorker1 和SparkWorker2上使用jps會看到如下進程信息:

啟動Spark集群

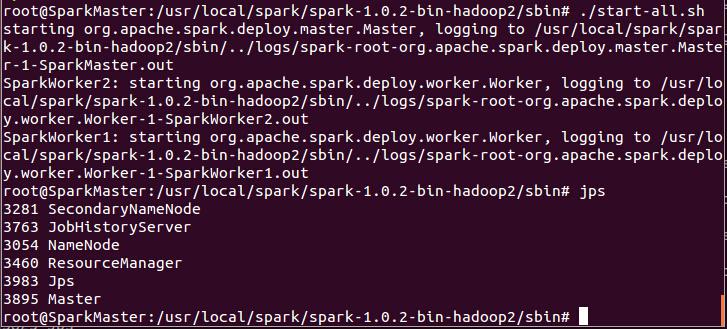

在Hadoop集群成功啟動的基礎上,啟動Spark集群需要使用Spark的sbin目錄下“start-all.sh”:

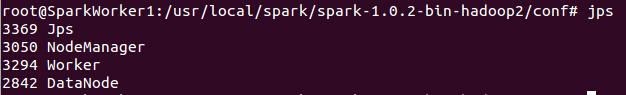

此時的SparkWorker1和SparkWorker2會出現新的進程“Worker”:

此時,我們可以進入Spark集群的Web頁面,訪問“http://SparkMaster:8080”: 如下所示:

從頁面上我們可以看到我們有兩個Worker節點及這兩個節點的信息。

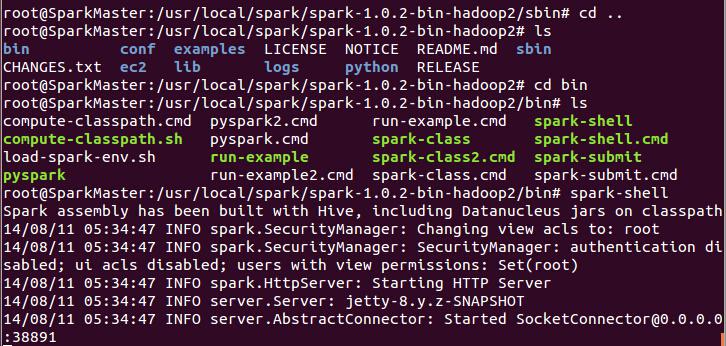

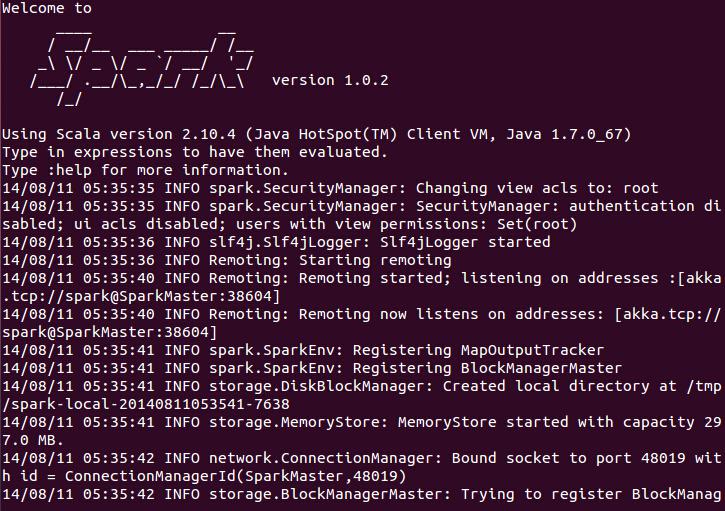

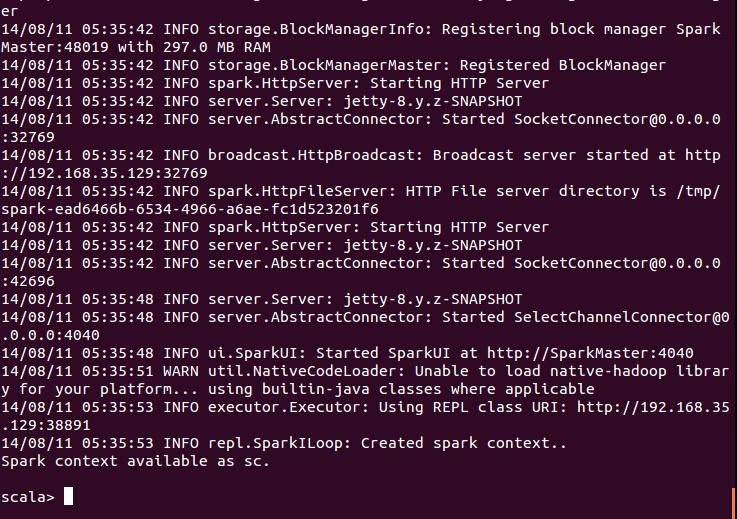

此時,我們進入Spark的bin目錄,使用“spark-shell”控制臺:

“如何啟動Spark集群”的內容就介紹到這里了,感謝大家的閱讀。如果想了解更多行業相關的知識可以關注億速云網站,小編將為大家輸出更多高質量的實用文章!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。