溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

爬取網站為:http://xiaohua.zol.com.cn/youmo/

查看網頁機構,爬取笑話內容時存在如下問題:

1、每頁需要進入“查看更多”鏈接下面網頁進行進一步爬取內容每頁查看更多鏈接內容比較多,多任務進行,這里采用線程池的方式,可以有效地控制系統中并發線程的數量。避免當系統中包含有大量的并發線程時,導致系統性能下降,甚至導致 Python 解釋器崩潰,引入線程池,花費時間更少,更效率。

2、查看鏈接笑話頁內容,div元素內部文本分布比較混亂。有的分布在<p>鏈接內有的屬于div的文本,可采用正則表達式的方式解決。

注意2種獲取元素節點的方式:

1)lxml獲取節點字符串

res=requests.get(url,headers=headers)

html = res.text

lxml 獲取節點寫法

element=etree.HTML(html)

divEle=element.xpath("http://div[@class='article-text']")[0] # 獲取div節點

div= etree.tostring(divEle, encoding = 'utf-8' ).decode('utf-8') # 轉換為div字符串

2)正則表達式寫法1,過濾回車、制表符和p標簽

# 第一種方式:replace

content = re.findall('<div class="article-text">(.*?)</div>',html,re.S)

content = content[0].replace('\r','').replace('\t','').replace('<p>','').replace('</p>','').strip()

3)正則表達式寫法2,過濾回車、制表符和p標簽

# 第二種方式:sub for index in range(len(content)): content[index] = re.sub(r'(\r|\t|<p>|<\/p>)+','',content[index]).strip() list = ''.join(content) print(list)

3、完整代碼

index.py

import requests

import threadpool

import time

import os,sys

import re

from lxml import etree

from lxml.html import tostring

class ScrapDemo():

next_page_url="" #下一頁的URL

page_num=1 #當前頁

detail_url_list=0 #詳情頁面URL地址list

deepth=0 #設置抓取的深度

headers = {

"user-agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/68.0.3440.84 Safari/537.36"

}

fileNum=0

def __init__(self,url):

self.scrapyIndex(url)

def threadIndex(self,urllist): #開啟線程池

if len(urllist) == 0:

print("請輸入需要爬取的地址")

return False

ScrapDemo.detail_url_list=len(urllist)

pool=threadpool.ThreadPool(len(urllist))

requests=threadpool.makeRequests(self.detailScray,urllist)

for req in requests:

pool.putRequest(req)

time.sleep(0.5)

pool.wait()

def detailScray(self,url): # 獲取html結構

if not url == "":

url='http://xiaohua.zol.com.cn/{}'.format(url)

res=requests.get(url,headers=ScrapDemo.headers)

html=res.text

# element=etree.HTML(html)

# divEle=element.xpath("http://div[@class='article-text']")[0] # Element div

self.downloadText(html)

def downloadText(self,ele): # 抓取數據并存為txt文件

clist = re.findall('<div class="article-text">(.*?)</div>',ele,re.S)

for index in range(len(clist)):

'''

正則表達式:過濾掉回車、制表符和p標簽

'''

clist[index]=re.sub(r'(\r|\t|<p>|<\/p>)+','',clist[index])

content="".join(clist)

# print(content)

basedir=os.path.dirname(__file__)

filePath=os.path.join(basedir)

filename="xiaohua{0}-{1}.txt".format(ScrapDemo.deepth,str(ScrapDemo.fileNum))

file=os.path.join(filePath,'file_txt',filename)

try:

f=open(file,"w")

f.write(content)

if ScrapDemo.fileNum == (ScrapDemo.detail_url_list - 1):

print(ScrapDemo.next_page_url)

print(ScrapDemo.deepth)

if not ScrapDemo.next_page_url == "":

self.scrapyIndex(ScrapDemo.next_page_url)

except Exception as e:

print("Error:%s" % str(e))

ScrapDemo.fileNum=ScrapDemo.fileNum+1

print(ScrapDemo.fileNum)

def scrapyIndex(self,url):

if not url == "":

ScrapDemo.fileNum=0

ScrapDemo.deepth=ScrapDemo.deepth+1

print("開啟第{0}頁抓取".format(ScrapDemo.page_num))

res=requests.get(url,headers=ScrapDemo.headers)

html=res.text

element=etree.HTML(html)

a_urllist=element.xpath("http://a[@class='all-read']/@href") # 當前頁所有查看全文

next_page=element.xpath("http://a[@class='page-next']/@href") # 獲取下一頁的url

ScrapDemo.next_page_url='http://xiaohua.zol.com.cn/{}'.format(next_page[0])

if not len(next_page) == 0 and ScrapDemo.next_page_url != url:

ScrapDemo.page_num=ScrapDemo.page_num+1

self.threadIndex(a_urllist[:])

else:

print('下載完成,當前頁數為{}頁'.format(ScrapDemo.page_num))

sys.exit()

runscrapy.py

from app import ScrapDemo url="http://xiaohua.zol.com.cn/youmo/" ScrapDemo(url)

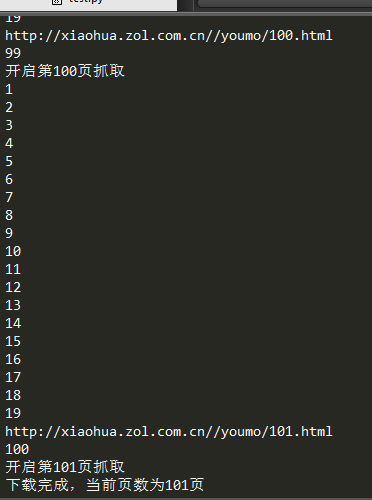

運行如下:

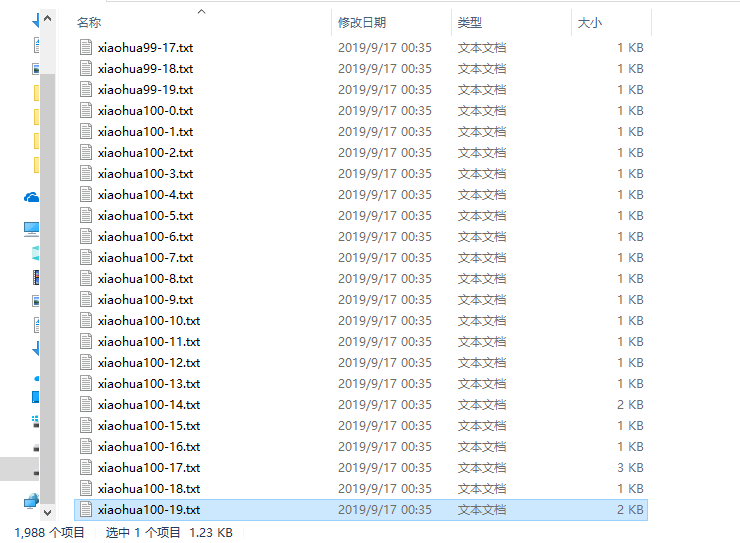

總共1988個文件,下載完成。

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持億速云。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。