您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

本篇內容介紹了“keras中卷積層Conv2D怎么使用”的有關知識,在實際案例的操作過程中,不少人都會遇到這樣的困境,接下來就讓小編帶領大家學習一下如何處理這些情況吧!希望大家仔細閱讀,能夠學有所成!

keras.layers.convolutional.Conv2D(filters,kernel_size,strides(1,1), padding='valid', data_format=None, dilation_rate=(1,1), activation=None, use_bias=True, kernel_initializer='glorot_uniform', bias_initializer='zeros', kernel_regularizer=None, bias_regularizer=None, activity_regularizer=None, kernel_constraint=None, bias_constraint=None)

此操作將二維向量進行卷積,當使用該層作為第一層時,應提供input_shape參數。

filters:卷積核的數目(即輸出的維度)。

kernel_size:單個整數或由兩個整數構成的list/tuple,卷積核的寬度和長度。如為單個整數,則表示在各個空間維度的相同長度。

strides:單個整數或由兩個整數構成的list/tuple,為卷積的步長。如為單個整數,則表示在各個空間維度的相同步長。任何不為1的strides均與任何不為1的dilation_rata均不兼容。

padding:補0策略,為“valid”, “same”。“valid”代表只進行有效的卷積,即對邊界數據不處理。“same”代表保留邊界處的卷積結果,通常會導致輸出shape與輸入shape相同。

activation:激活函數,為預定義的激活函數名(參考激活函數),或逐元素(element-wise)的Theano函數。如果不指定該參數,將不會使用任何激活函數(即使用線性激活函數:a(x)=x)。

dilation_rate:單個整數或由兩個個整數構成的list/tuple,指定dilated convolution中的膨脹比例。任何不為1的dilation_rata均與任何不為1的strides均不兼容。

data_format:字符串,“channels_first”或“channels_last”之一,代表圖像的通道維的位置。該參數是Keras 1.x中的image_dim_ordering,“channels_last”對應原本的“tf”,“channels_first”對應原本的“th”。以128x128的RGB圖像為例,“channels_first”應將數據組織為(3,128,128),而“channels_last”應將數據組織為(128,128,3)。該參數的默認值是~/.keras/keras.json中設置的值,若從未設置過,則為“channels_last”。

use_bias:布爾值,是否使用偏置項。

kernel_initializer:權值初始化方法,為預定義初始化方法名的字符串,或用于初始化權重的初始化器。

bias_initializer:權值初始化方法,為預定義初始化方法名的字符串,或用于初始化權重的初始化器。

kernel_regularizer:施加在權重上的正則項,為Regularizer對象。

bias_regularizer:施加在偏置向量上的正則項,為Regularizer對象。

activity_regularizer:施加在輸出上的正則項,為Regularizer對象。

kernel_constraints:施加在權重上的約束項,為Constraints對象。

bias_constraints:施加在偏置上的約束項,為Constraints對象。

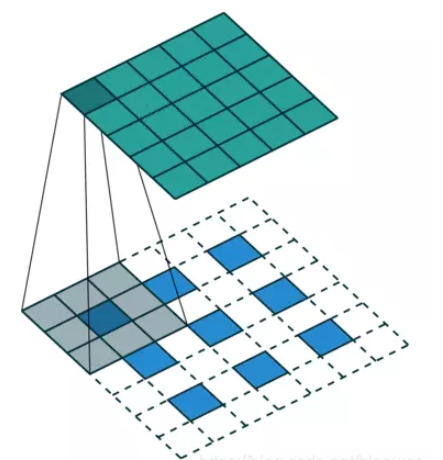

conv2d和conv2dTranspose屬于最常用的層,但在keras的實現中關于padding的部分有點模糊,周末趁著空閑做了一些嘗試,來實驗padding的valid和same參數在實際過程中如何操作的。

conv2D部分

v_input = np.ones([1,5,5,1]) kernel = np.ones([3,3]) stride = 1 model = Sequential() model.add(Conv2D(1, kernel_size=(3, 3), activation='relu', padding="valid" , # "same" strides = 1, # dilation_rate = 1, kernel_initializer = keras.initializers.Ones(), input_shape=v_input.shape[1:]))

其中stride可以嘗試多組測試

padding在valid 和 same 間切換測試

padding 為valid則不進行填充, 根據stride的滑動大小來做平移, 則:

output_shape = ceil( (input_shape - (kernel_size - 1)) / stride )

如果是same模式則 會進行左右上下的補齊, 其中左,上依次補齊 flood (kernel_size -1 ) / 2 , 右下補齊ceil (( kernel_size - 1) /2 ) ,補齊后進行的操作就是類似valid下的滑動卷積

output_shape = ceil (input_shape / stride)

ceil表示上取整

flood表示下取整

v_input = np.ones([1,5,5,1]) kernel = np.ones([3,3]) stride = 1 model = Sequential() model.add(Conv2DTranspose(1, kernel_size=(3, 3), activation='relu', padding="valid" , # "same" strides = 1, # dilation_rate = 1, kernel_initializer = keras.initializers.Ones(), input_shape=v_input.shape[1:]))

如果padding的設置為valid則,保持最小相交的原則上下左右均填充kernel_size大小,如果stride設置為非1,起實際的作用和dilation_rate一樣均是在矩陣中進行填充(實際滑動是永遠都是1) 具體填充出來的矩陣大小是 (input_size -1) * stride + 1 + 2 * (kernel_size - 1)

之后就是按照這個矩陣做著類似conv2d valid的卷積 則:

output_shape = (input_size -1) * stride + 1 + 2 * (kernel_size - 1) - (kernel_size -1) = (input_size - 1) * stride + kernel_size

如果padding為same的話則output_shape = input_shape * stride

其中原始矩陣左上padding = ceil (( kernel_size ) /2 ) 右下補齊 flood (( kernel_size ) /2 ) 這里conv2d

“keras中卷積層Conv2D怎么使用”的內容就介紹到這里了,感謝大家的閱讀。如果想了解更多行業相關的知識可以關注億速云網站,小編將為大家輸出更多高質量的實用文章!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。