您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

本篇內容主要講解“基于python怎么實現cdn日志文件導入mysql進行分析”,感興趣的朋友不妨來看看。本文介紹的方法操作簡單快捷,實用性強。下面就讓小編來帶大家學習“基于python怎么實現cdn日志文件導入mysql進行分析”吧!

周六日出現CDN大量請求,現需要分析其請求頻次與來源,查詢是否存在被攻擊問題。

本文以阿里云CDN日志作為輔助查詢數據,其它云平臺大同小異。

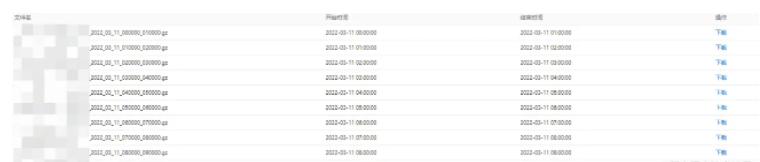

系統提供的離線日志如下所示:

日志實例如下所示:

[9/Jun/2015:01:58:09 +0800] 10.10.10.10 - 1542 "-" "GET http://www.aliyun.com/index.html" 200 191 2830 MISS "Mozilla/5.0 (compatible; AhrefsBot/5.0; +http://example.com/robot/)" "text/html"

其中相關字段的解釋如下:

[9/Jun/2015:01:58:09 +0800]:日志開始時間。

10.10.10.10:訪問IP。

-:代理IP。

1542:請求響應時間,單位為毫秒。

"-": HTTP請求頭中的Referer。

GET:請求方法。

http://www.aliyun.com/index.html:用戶請求的URL鏈接。

200:HTTP狀態碼。

191:請求大小,單位為字節。

2830:請求返回大小,單位為字節。

MISS:命中信息。

HIT:用戶請求命中了CDN邊緣節點上的資源(不需要回源)。

MISS:用戶請求的內容沒有在CDN邊緣節點上緩存,需要向上游獲取資源(上游可能是CDN L2節點,也可能是源站)。

Mozilla/5.0(compatible; AhrefsBot/5.0; +http://example.com/robot/):User-Agent請求頭信息。

text/html:文件類型。

按照上述字段說明創建一個 MySQL 表,用于后續通過 Python 導入 MySQL 數據,字段可以任意定義

SET NAMES utf8mb4; SET FOREIGN_KEY_CHECKS = 0; -- ---------------------------- -- Table structure for ll -- ---------------------------- DROP TABLE IF EXISTS `ll`; CREATE TABLE `ll` ( `id` int(11) NOT NULL, `s_time` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `ip` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `pro_ip` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `dura_time` int(11) NULL DEFAULT NULL, `referer` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `method` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `url` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `code` int(255) NULL DEFAULT NULL, `size` double NULL DEFAULT NULL, `res_size` double NULL DEFAULT NULL, `miss` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `ua` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, `html_type` varchar(255) CHARACTER SET utf8 COLLATE utf8_general_ci NULL DEFAULT NULL, PRIMARY KEY (`id`) USING BTREE ) ENGINE = MyISAM CHARACTER SET = utf8 COLLATE = utf8_general_ci ROW_FORMAT = Dynamic; SET FOREIGN_KEY_CHECKS = 1;

下載全部日志之后,使用 Python 批量導入數據庫中,解析代碼如下,在提前開始前需要先看一下待提取的每行數據內容。

[11/Mar/2022:00:34:17 +0800] 118.181.139.215 - 1961 "http://xx.baidu.cn/" "GET https://cdn.baidu.com/video/1111111111.mp4" 206 66 3739981 HIT "Mozilla/5.0 (iPad; CPU OS 15_1 like Mac OS X) AppleWebKit/605.1.15 (KHTML, like Gecko) Mobile/15E148 SP-engine/2.43.0 main%2F1.0 baiduboxapp/13.5.0.10 (Baidu; P2 15.1) NABar/1.0" "video/mp4"

初看之下,我們會使用空格進行切片,例如下述代碼:

import os

# 獲取文件名

my_path = r"C:日志目錄"

file_names = os.listdir(my_path)

file_list = [os.path.join(my_path, file) for file in file_names]

for file in file_list:

with open(file, 'r', encoding='utf-8') as f:

lines = f.readlines()

for i in lines:

item_list = i.split(' ')

s_time = item_list[0]+' '+item_list[1]

ip = item_list[2],

pro_ip =item_list[3],

dura_time =item_list[4],

referer =item_list[5],

method =item_list[6],

url = item_list[7],

code =item_list[8],

size =item_list[9],

res_size =item_list[10],

miss =item_list[11],

html_type =item_list[12]

print(s_time,ip,pro_ip,dura_time,referer,method,url,code,size,res_size,miss,html_type)運行之后,會發現里面的開始時間位置,UA位置都存在空格,所以該方案舍棄,接下來使用正則表達式提取。

參考待提取的模板編寫正則表達式如下所示:

\[(?<time>.*?)\] (?<ip>\d{1,3}\.\d{1,3}\.\d{1,3}\.\d{1,3}) (?<pro_ip>.*?) (?<dura_time>\d+) \"(?<referer>.*?)\" \"(?<method>.*?) (?<url>.*?)\" (?<code>\d+) (?<size>\d+) (?<res_size>\d+) (?<miss>.*?) \"(?<ua>.*?)\" \"(?<html_type>.*?)\"

接下來進行循環讀取數據,然后進行提取:

import os

import re

import pymysql

# 獲取文件名

my_path = r"C:日志文件夾"

file_names = os.listdir(my_path)

file_list = [os.path.join(my_path, file) for file in file_names]

wait_list = []

for file in file_list:

with open(file, 'r', encoding='utf-8') as f:

lines = f.readlines()

for i in lines:

pattern = re.compile(

'\[(?P<time>.*?)\] (?P<ip>\d{1,3}\.\d{1,3}\.\d{1,3}\.\d{1,3}) (?P<pro_ip>.*?) (?P<dura_time>\d+) \"(?P<referer>.*?)\" \"(?P<method>.*?) (?P<url>.*?)\" (?P<code>\d+) (?P<size>\d+) (?P<res_size>\d+) (?P<miss>.*?) \"(?P<ua>.*?)\" \"(?P<html_type>.*?)\"')

gs = pattern.findall(i)

item_list = gs[0]

s_time = item_list[0]

ip = item_list[1]

pro_ip = item_list[2]

dura_time = item_list[3]

referer = item_list[4]

method = item_list[5]

url = item_list[6]

code = item_list[7]

size = item_list[8]

res_size = item_list[9]

miss = item_list[10]

ua = item_list[11]

html_type = item_list[12]

values_str = f"('{s_time}', '{ip}', '{pro_ip}', {int(dura_time)}, '{referer}', '{method}', '{url}', {int(code)}, {int(size)}, {int(res_size)}, '{miss}', '{ua}','{html_type}')"

wait_list.append(values_str)讀取到數據存儲到 wait_list 列表中,然后操作列表,寫入MySQL,該操作為了防止SQL語句過長,所以每次間隔1000元素進行插入。

def insert_data():

for i in range(0,int(len(wait_list)/1000+1)):

items = wait_list[i * 1000:i * 1000 + 1000]

item_str = ",".join(items)

inser_sql = f"INSERT INTO ll(s_time, ip, pro_ip, dura_time, referer, method, url,code, size, res_size, miss, ua,html_type) VALUES {item_str}"

db = pymysql.connect(host='localhost',

user='root',

password='root',

database='logs')

cursor = db.cursor()

try:

cursor.execute(inser_sql)

db.commit()

except Exception as e:

# print(content)

print(e)

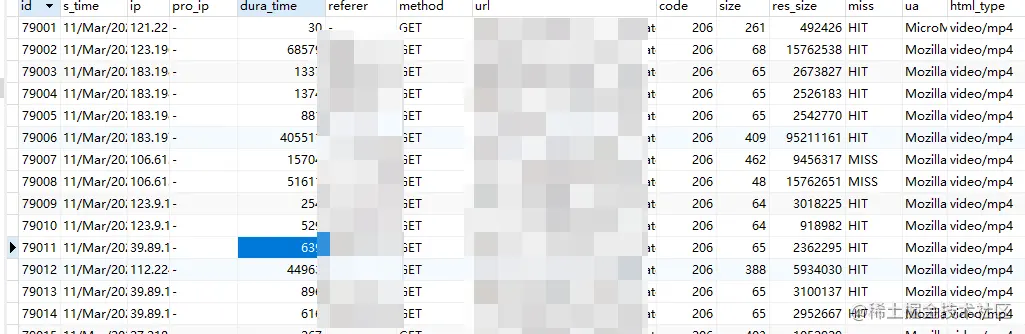

db.rollback()最終的結果如下所示:

導入MySQL之后,就可以按照自己的需求進行排序與查詢了。

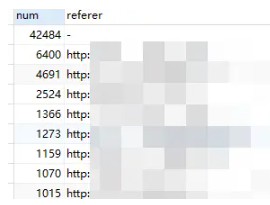

可以通過 refer 計算請求次數:

select count(id) num,referer from ll GROUP BY referer ORDER BY num desc

到此,相信大家對“基于python怎么實現cdn日志文件導入mysql進行分析”有了更深的了解,不妨來實際操作一番吧!這里是億速云網站,更多相關內容可以進入相關頻道進行查詢,關注我們,繼續學習!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。