溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

小編給大家分享一下如何使用TensorFlow神經網絡構造線性回歸模型,相信大部分人都還不怎么了解,因此分享這篇文章給大家參考一下,希望大家閱讀完這篇文章后大有收獲,下面讓我們一起去了解一下吧!

先制作一些數據:

import numpy as np

import tensorflow as tf

import matplotlib.pyplot as plt

# 隨機生成1000個點,圍繞在y=0.1x+0.3的直線周圍

num_points = 1000

vectors_set = []

for i in range(num_points):

x1 = np.random.normal(0.0, 0.55)

# np.random.normal(mean,stdev,size)給出均值為mean,標準差為stdev的高斯隨機數(場),當size賦值時,如:size=100,表示返回100個高斯隨機數。

y1 = x1 * 0.1 + 0.3 + np.random.normal(0.0, 0.03)

# 后面加的高斯分布為人為噪聲

vectors_set.append([x1, y1])

# 生成一些樣本

x_data = [v[0] for v in vectors_set]

y_data = [v[1] for v in vectors_set]

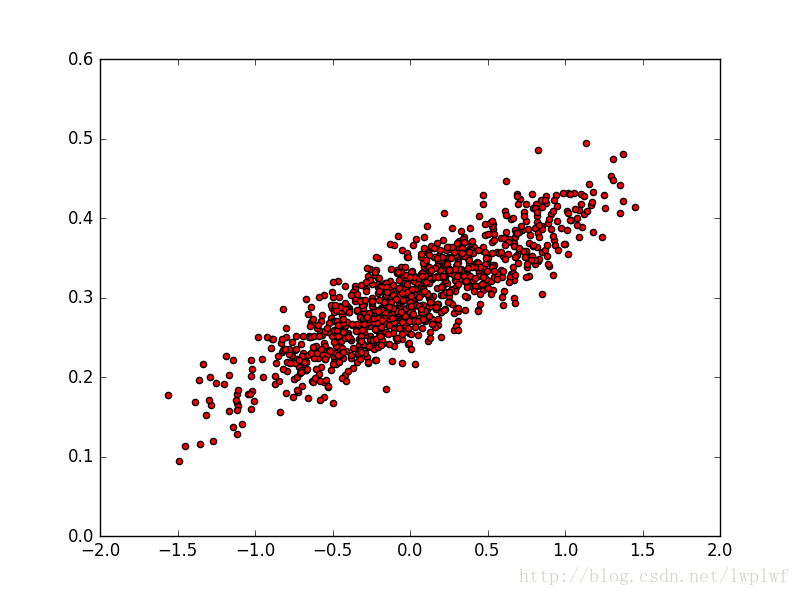

plt.scatter(x_data, y_data, c='r')

plt.show()

# 構造1維的w矩陣,取值是隨機初始化權重參數為[-1, 1]之間的隨機數

w = tf.Variable(tf.random_uniform([1], -1.0, 1.0), name='w')

# 構造1維的b矩陣,初始化為0

b = tf.Variable(tf.zeros([1]), name='b')

# 建立回歸公式,經過計算得出估計值y

y = w * x_data +b

# 定義loss函數,估計值y和實際值y_data之間的均方誤差作為損失

loss = tf.reduce_mean(tf.square(y - y_data), name='loss')

# 采用梯度下降法來優化參數,學習率為0.5

optimizer = tf.train.GradientDescentOptimizer(0.5)

# train相當于一個優化器,訓練的過程就是最小化loss

train = optimizer.minimize(loss, name='train')

sess = tf.Session()

# 全局變量的初始化

init = tf.global_variables_initializer()

sess.run(init)

# 打印初始化的w和b

print('w = ', sess.run(w), 'b = ', sess.run(b), 'loss = ', sess.run(loss))

# 訓練迭代20次

for step in range(20):

sess.run(train)

# 打印訓練好的w和b

print('w = ', sess.run(w), 'b = ', sess.run(b), 'loss = ', sess.run(loss))代碼運行一下,下面這個圖就是上面代碼剛剛構造的數據點:

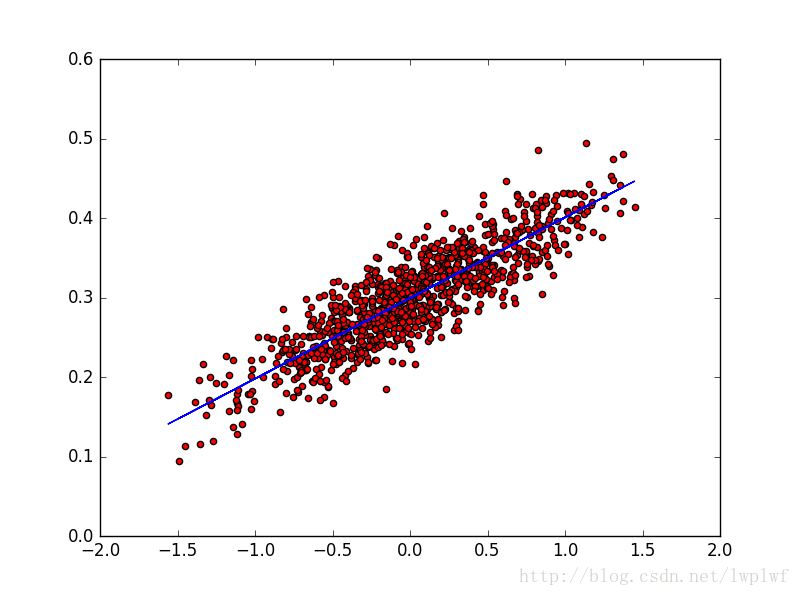

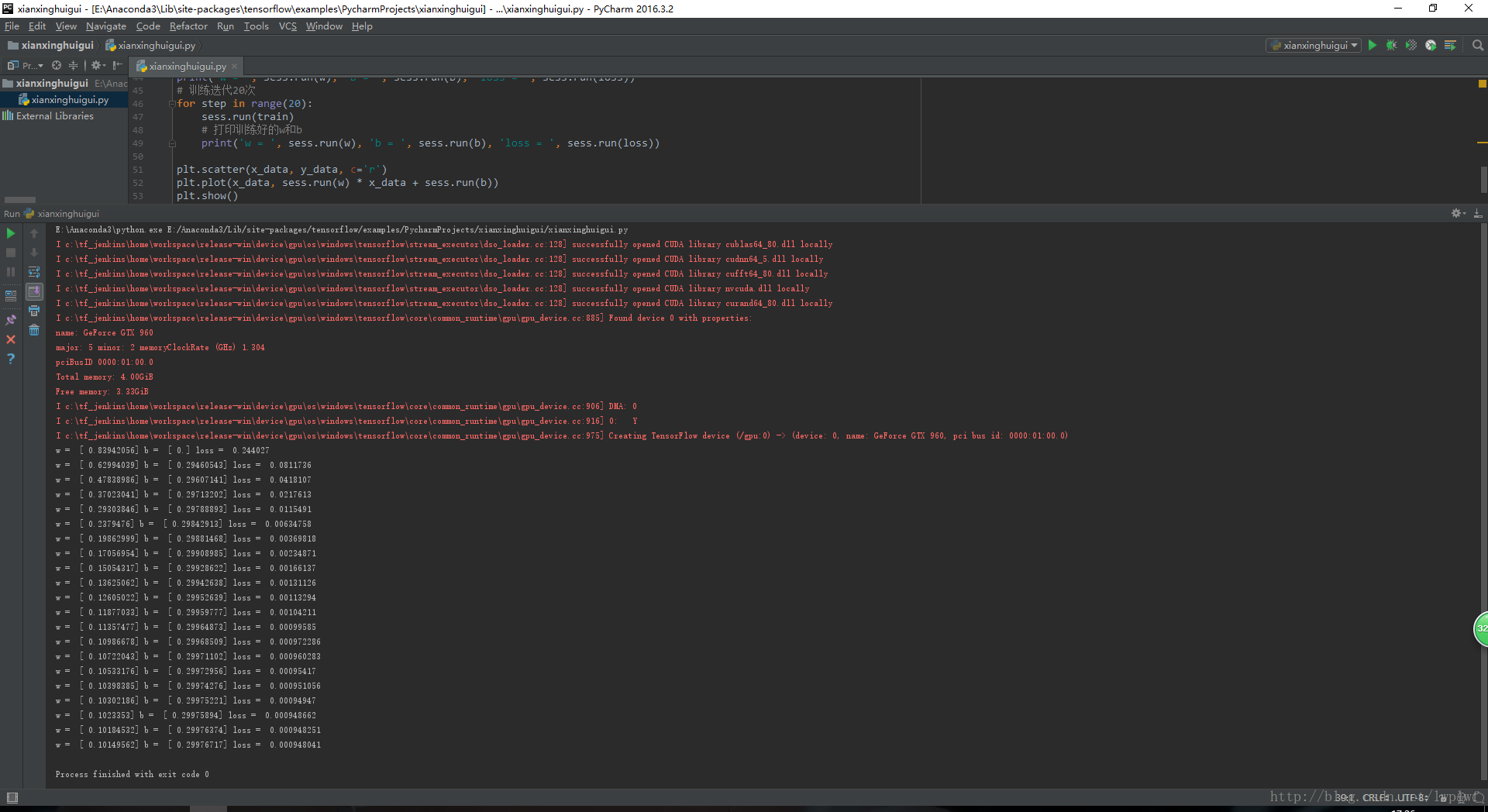

有了數據之后,接下來構造線性回歸模型,去學習出來這個數據符合什么樣的w和b,訓練完后看下得到的w和b是不是接近構造數據時的w和b,最后一次結果是w = [ 0.10149562] b = [ 0.29976717] loss = 0.000948041的,也就是這個線性回歸模型學習到了數據的分布規則。也可以看出隨著訓練次數的迭代,loss值也越來越小,也就是模型越來越好,將訓練出來的w和b構造成圖中藍色的線,這條線就是當前最能擬合數據的直線了。運行結果如圖所示:

以上是“如何使用TensorFlow神經網絡構造線性回歸模型”這篇文章的所有內容,感謝各位的閱讀!相信大家都有了一定的了解,希望分享的內容對大家有所幫助,如果還想學習更多知識,歡迎關注億速云行業資訊頻道!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。