您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這期內容當中小編將會給大家帶來有關基于RNN網絡的Deepfake檢測是怎樣的,文章內容豐富且以專業的角度為大家分析和敘述,閱讀完這篇文章希望大家可以有所收獲。

今天給大家介紹的是一篇基于CNN+RNN結構的檢測Deepfakes框架

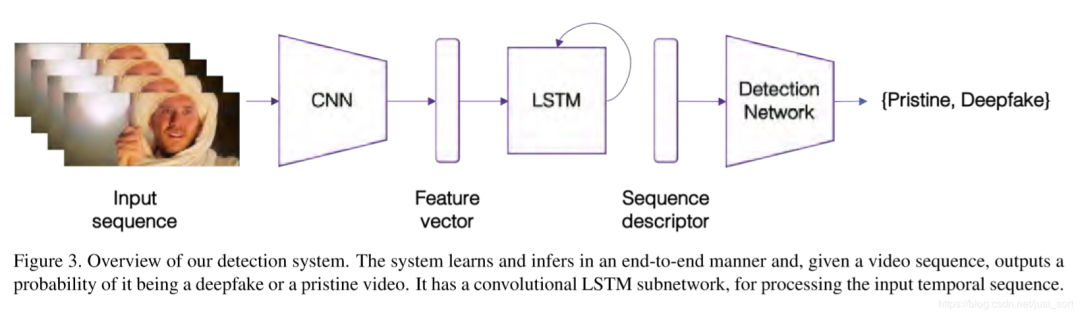

大部分檢測假臉工作是在圖片上進行的,而針對deepfake視頻往往有很少檢測方法。這個工作里我們提出了一種基于時間序列的處理方法,用于檢測Deepfake視頻。我們采用了CNN去提取幀級別的高維特征,并用這些高維特征訓練RNN。我們展示了通過一個簡單的架構也能在檢測任務上達到不俗的效果。

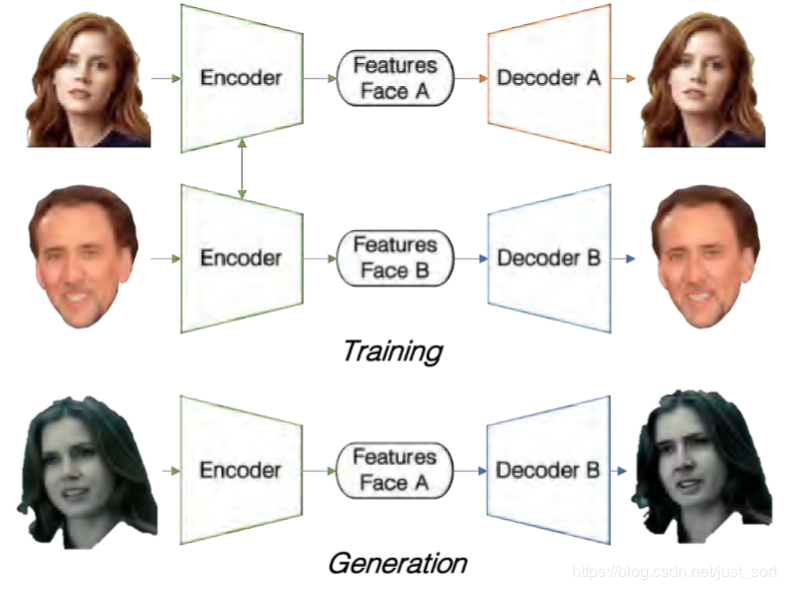

深度學習方法可用于圖片壓縮性能, 最常用的就是自編解碼器(AutoEncoder-Decoder)。自編碼器可以通過最小化損失函數,將圖片壓縮成一個高維特征,這比現有的壓縮方法都要來的高效

而編碼器則是將高維特征映射回圖片,如Figure2所示

使得Deepfakes生效,關鍵是將兩個潛在的人臉編碼到相同的特征上

我們通過共享一個自編碼器權重,而去分別訓練兩個自解碼器。

當我們去替換人臉的時候,先對輸入圖像編碼,再用目標人臉解碼器去解碼

但是自編解碼器在不同攝像角度,不同光照等復雜條件下,很難去生成人臉。種種條件變化導致人臉替換部分與背景在視覺上不一致,這種幀級別的場景不一致性將是我們方法利用的第一個特性

第二個特性來自于替換人臉需要用到人臉檢測器,而自編解碼器只關注人臉部分,很少去關注余下的背景信息,因此最后融合很容易出現邊界效應

第三個特性是自編解碼器是獨立于每一幀的,它并不考慮前后幀生成人臉圖片效果。最突出的是幀與幀之間光源的不一致性,導致假臉有閃爍現象,這種特征是很適合使用CNN來進行像素級別的檢測。

至此我們確定了基礎架構,由CNN提取幀特征,由LSTM進行時間序列上的分析,我們的網絡還包含2個全連接層加Dropout以防模型過擬合

我們使用預訓練后的InceptionV3網絡作為CNN結構,對輸入的圖片抽取出2048個特征。

抽取得到的2048特征,送入LSTM單元,接一個512單元的全連接層,0.5概率的Dropout,最后通過softmax計算概率,做最終的二分類

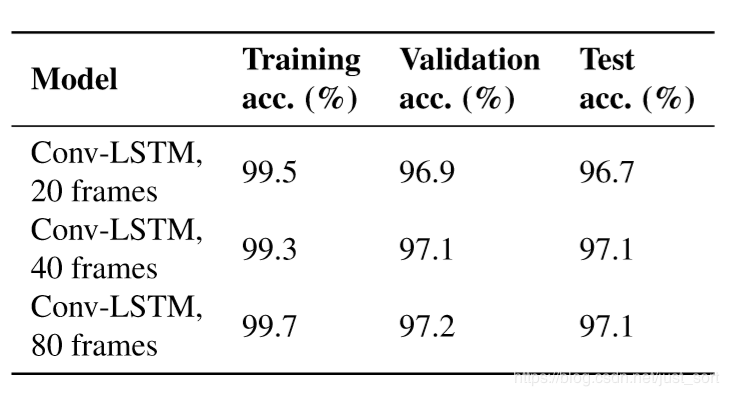

最終結果顯示增加幀序列,能提高一定的準確率,但是提升幅度不是很大

上述就是小編為大家分享的基于RNN網絡的Deepfake檢測是怎樣的了,如果剛好有類似的疑惑,不妨參照上述分析進行理解。如果想知道更多相關知識,歡迎關注億速云行業資訊頻道。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。