您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹“hadoop默認的轉換類是什么”,在日常操作中,相信很多人在hadoop默認的轉換類是什么問題上存在疑惑,小編查閱了各式資料,整理出簡單好用的操作方法,希望對大家解答”hadoop默認的轉換類是什么”的疑惑有所幫助!接下來,請跟著小編一起來學習吧!

默認是下面的轉換類

job.setInputFormatClass(TextInputFormat.class)

List<InputSplit> InputFormat.getSplits首先對輸入的數據做切分,切分后的split書面決定map的任務數;

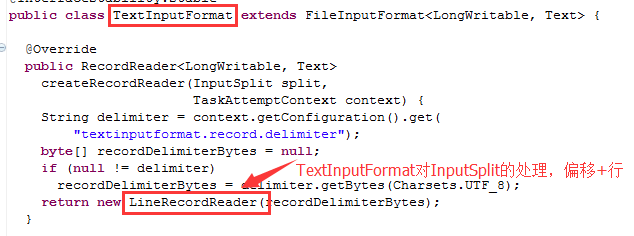

RecordReader<K,V> InputFormat.createRecordReader(InputSplit split, ...)傳入切分的數據,處理成key、value,然后把keyvalue值送給map執行,每一對key、value對都會調用一次map;

FileInputFormat<K, V> extends InputFormat<K, V>

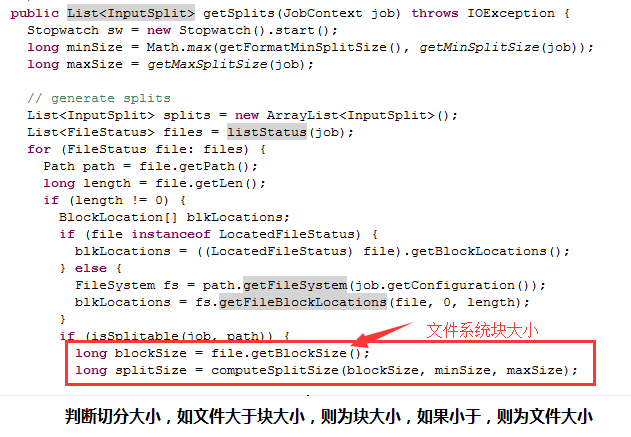

List<InputSplit> FileInputFormat.getSplits

TextInputFormat extends FileInputFormat<LongWritable, Text>

到此,關于“hadoop默認的轉換類是什么”的學習就結束了,希望能夠解決大家的疑惑。理論與實踐的搭配能更好的幫助大家學習,快去試試吧!若想繼續學習更多相關知識,請繼續關注億速云網站,小編會繼續努力為大家帶來更多實用的文章!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。