您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹如何安裝單機版hadoop相關套件,文中介紹的非常詳細,具有一定的參考價值,感興趣的小伙伴們一定要看完!

配置文件在 $HADOOP_HOME/etc/hadoop 目錄下。

配置 hadoop-env.sh ,添加屬性

# The java implementation to use. export JAVA_HOME=/home/java/jdk1.8.0_191 export HADOOP_OPTS="$HADOOP_OPTS -Duser.timezone=GMT+08"

配置 core-site.xml

<configuration> <!-- 用來指定hdfs的NameNode的地址 --> <property> <name>fs.defaultFS</name> <value>hdfs://hadoop-standalone:9000</value> </property> <!-- 用來指定Hadoop運行時產生文件的存放目錄 --> <property> <name>hadoop.tmp.dir</name> <value>/home/data/hadoop</value> </property> <property> <name>hadoop.proxyuser.hadoop.hosts</name> <value>*</value> </property> <property> <name>hadoop.proxyuser.hadoop.groups</name> <value>*</value> </property> </configuration>

配置 hdfs-site.xml

<configuration> <property> <name>dfs.replication</name> <value>1</value> </property> <property> <name>dfs.permissions.enabled</name> <value>false</value> </property> <property> <name>dfs.webhdfs.enabled</name> <value>true</value> </property> </configuration>

配置 mapred-site.xml

<configuration> <property> <name>mapreduce.framework.name</name> <value>yarn</value> </property> <!-- 日志查看頁面. --> <property> <name>mapreduce.jobhistory.address</name> <value>hadoop-standalone:10020</value> </property> <property> <name>mapreduce.jobhistory.webapp.address</name> <value>hadoop-standalone:19888</value> </property> <!-- 配置正在運行中的日志在hdfs上的存放路徑 --> <property> <name>mapreduce.jobhistory.intermediate-done-dir</name> <value>/history/done_intermediate</value> </property> <!-- 配置運行過的日志存放在hdfs上的存放路徑 --> <property> <name>mapreduce.jobhistory.done-dir</name> <value>/history/done</value> </property> </configuration>

配置 yarn-site.xml

<configuration> <!-- NodeManager獲取數據的方式是shuffle--> <property> <name>yarn.nodemanager.aux-services</name> <value>mapreduce_shuffle</value> </property> <!-- 指定YARN的老大(resourcemanager)的地址 --> <property> <name>yarn.resourcemanager.hostname</name> <value>hadoop-standalone</value> </property> <property> <name>yarn.log-aggregation-enable</name> <value>true</value> </property> <property> <name>yarn.nodemanager.log-aggregation.debug-enabled</name> <value>true</value> </property> <property> <name>yarn.nodemanager.log-aggregation.roll-monitoring-interval-seconds</name> <value>3600</value> </property> <property> <name>yarn.log.server.url</name> <value>http://hadoop-standalone:19888/jobhistory/logs</value> </property> </configuration>

yarn-env.sh 配置中添加

YARN_OPTS="$YARN_OPTS -Duser.timezone=GMT+08"

格式化namenode

hdfs namenode -format

分別啟動 hdfs / yarn / jobhistory服務器

$HADOOP_HOME/sbin/start-dfs.sh

$HADOOP_HOME/sbin/start-yarn.sh

$HADOOP_HOME/sbin/mr-jobhistory-daemon.sh start historyserver

分別訪問

http://hadoop-standalone:50070

http://hadoop-standalone:8088

先安裝scala, 再在系統的環境變量中配置SPARK_HOME

然后配置 spark-env.sh

export JAVA_HOME=/home/java/jdk1.8.0_191 export SCALA_HOME=/home/scala2.11.12 export HADOOP_HOME=/home/hadoop-2.7.7 export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop export SPARK_LOCAL_DIRS=/home/data/spark

配置 spark-defaults.conf

spark.yarn.jars hdfs://hadoop-standalone:9000/spark/share/lib/*.jar spark.eventLog.enabled true spark.eventLog.dir hdfs://hadoop-standalone:9000/spark/spark-events spark.history.ui.port 18080 spark.history.retainedApplications 10 spark.history.fs.logDirectory hdfs://hadoop-standalone:9000/spark/spark-events

spark的運行包上傳到dfs

hdfs dfs -put $SPARK_HOME/jars/* /spark/share/lib

啟動 spark history 服務器

$SPARK_HOME/sbin/start-history-server.sh

master和slave都是同一臺機子, 即管理者和工人都是自己

啟動 spark master 和 slaves服務

$SPARK_HOME/sbin/start-master.sh

$SPARK_HOME/sbin/start-slaves.sh

下面是默認的端口

SPARK_MASTER_PORT=7077 # 提交任務的端口 SPARK_MASTER_WEBUI_PORT=8080 # webui端口,查看任務進程

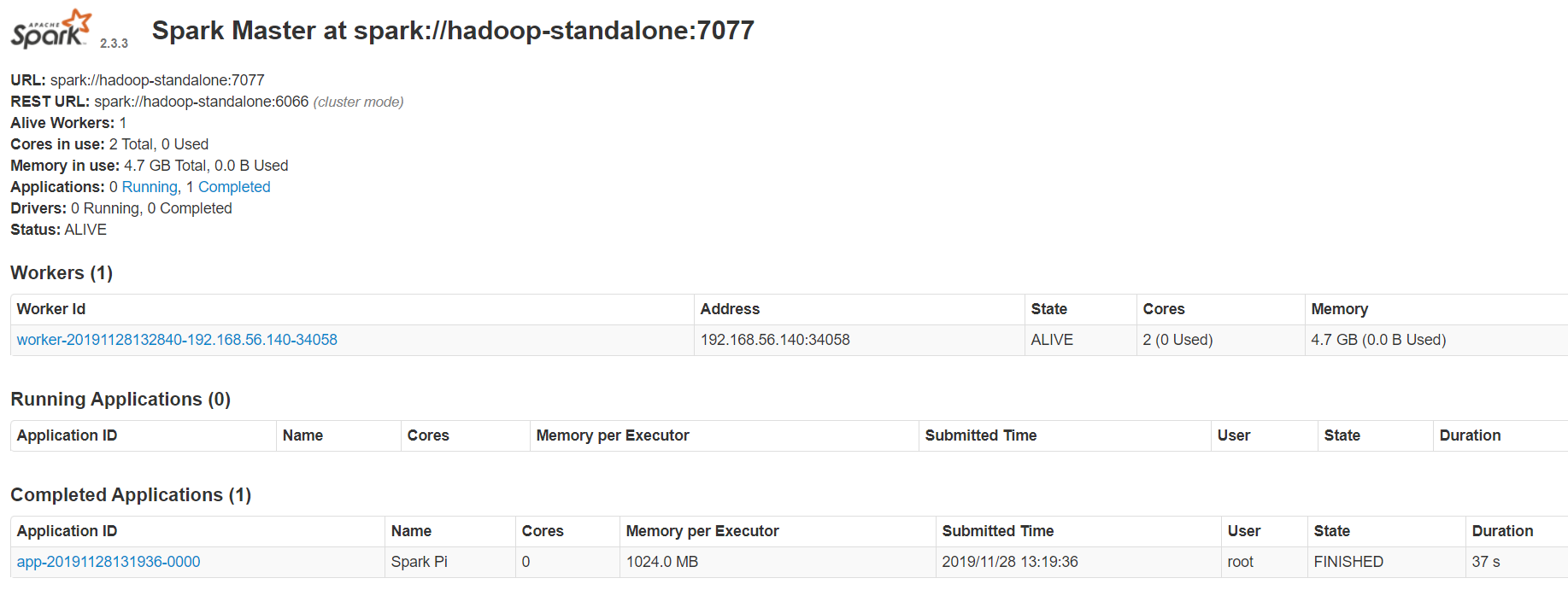

打開頁面 http://hadoop-standalone:8080/ , 可以看到有worker已經加入到集群

用于一些組件的元數據 ,需要事先啟動

添加環境變量

#hive export HIVE_HOME=/usr/local/hive export PATH=$PATH:$HIVE_HOME/bin

復制mysql的驅動程序到hive/lib

配置hive.env.sh

export HADOOP_HOME=/opt/hadoop-2.6.5 # Hive Configuration Directory can be controlled by: export HIVE_CONF_DIR=/opt/hive-2.3.5/conf

修改log生成的目錄。配置文件hive-log4j.properties。修改到你所需的目錄

property.hive.log.dir = /opt/hive-2.3.5/logs

配置 hive-site.xml

<?xml version="1.0" encoding="UTF-8" standalone="no"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration> <!--hdfs上hive數據存放位置 --> <property> <name>hive.metastore.warehouse.dir</name> <value>/user/hive/warehouse</value> </property> <!--連接數據庫地址,名稱 --> <property> <name>javax.jdo.option.ConnectionURL</name> <value>jdbc:mysql://localhost:3306/hive?createDatabaseIfNotExist=true&useSSL=false</value> </property> <!--連接數據庫驅動 --> <property> <name>javax.jdo.option.ConnectionDriverName</name> <value>com.mysql.jdbc.Driver</value> </property> <!--連接數據庫用戶名稱 --> <property> <name>javax.jdo.option.ConnectionUserName</name> <value>root</value> </property> <!--連接數據庫用戶密碼 --> <property> <name>javax.jdo.option.ConnectionPassword</name> <value>123456</value> </property> <!--客戶端顯示當前查詢表的頭信息 --> <property> <name>hive.cli.print.header</name> <value>true</value> </property> <!--客戶端顯示當前數據庫名稱信息 --> <property> <name>hive.cli.print.current.db</name> <value>true</value> </property> <property> <name>hive.metastore.port</name> <value>9083</value> <description>Hive metastore listener port</description> </property> <property> <name>hive.server2.thrift.port</name> <value>10000</value> <description>Port number of HiveServer2 Thrift interface when hive.server2.transport.mode is 'binary'.</description> </property> <!-- 客戶端配置,連接遠端的metadata --> <property> <name>hive.metastore.local</name> <value>false</value> </property> <property> <name>hive.metastore.uris</name> <value>thrift://192.168.56.140:9083</value> </property> <property> <name>hive.metastore.schema.verification</name> <value>false</value> </property> </configuration>

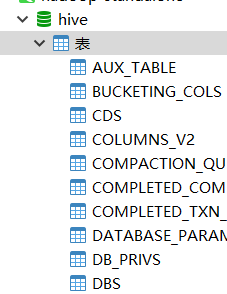

初始化hive的meta數據庫(mysql)

schematool -dbType mysql -initSchema

啟動hive的命令行客戶端,試運行

hive

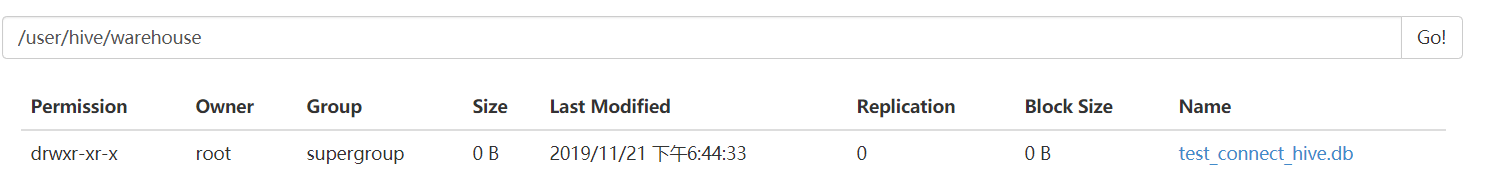

創建個數據庫測試下:

create database test_connect_hive;

使用jdbc客戶端連接hiveserver2

在hadoop/core-site.xml 添加配置。其中 root 是現在用的用戶名(報錯那里有)

<property> <name>hadoop.proxyuser.root.hosts</name> <value>*</value> </property> <property> <name>hadoop.proxyuser.root.groups</name> <value>*</value> </property>

修改hadoop要重啟.

下面分別啟動 metastore 訪問服務和hiveserver2服務

nohup hive --service metastore >> /home/data/hive/metastore.log 2>&1 & nohup hive --service hiveserver2 >> /home/data/hive/hiveserver2.log 2>&1 &

通過 beelines 客戶端連接 hiveserver2 測試。

beeline

輸入連接的地址

!connect jdbc:hive2://localhost:10000

將hive的配置文件拷貝給spark

將 $HIVE_HOME/conf/hive-site.xml copy $SPARK_HOME/conf/

dfs: http://hadoop-standalone:50070/explorer.html#/ spark master(standalone): http://hadoop-standalone:8080 spark history: http://hadoop-standalone:18080/

以上是“如何安裝單機版hadoop相關套件”這篇文章的所有內容,感謝各位的閱讀!希望分享的內容對大家有幫助,更多相關知識,歡迎關注億速云行業資訊頻道!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。