您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

作者 | 曹勝利??Apache Dubbo PMC

導讀:Dubbo 作為高性能 Java RPC 框架的刻板印象早已深入人心,在 Cloud Native 的架構選型上,Spring Cloud 或許才是業界的優先選擇。實際上,Dubbo 已經悄然地衍進為 Cloud Native 基礎設施,不僅承襲過去 RPC 時代的榮耀,而且也完善了現有基礎設施的缺失。自從容器和 K8s 登上舞臺之后,給原有的 RPC 領域帶來了很大的挑戰,本文主要講述 RPC 領域遇到的問題,以及 RPC 怎么去擁抱 K8s 的一些思考。

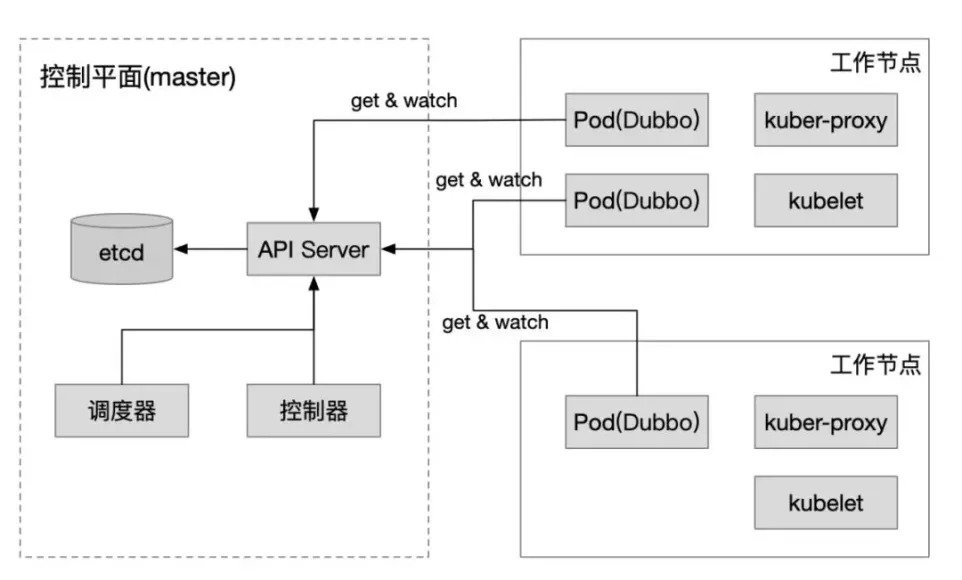

Kubernetes 是一個開源的,用于管理云平臺中多個主機上的容器化的應用, Kubernetes 的目標是讓部署容器化的應用簡單并且高效, Kubernetes 提供了應用部署、規劃、更新、維護的一種機制。Kubernetes 簡稱 K8s。

cdn.com/90e5b6bb184faa3ce95c9494ae165a8d1841dce9.jpeg">

在 Kubernetes 中,最小的管理元素不是一個個獨立的容器,而是 Pod 。Pod 的生命周期需要注意以下幾點:

如果一些 Pods 提供了一些功能供其它的 Pod 使用,在 Kubernete 集群中是如何實現讓這些前臺能夠持續的追蹤到這些后臺的?答案是:Service 。

Kubernete Service 是一個定義了一組 Pod 的策略抽象,這些被服務標記的 Pod 一般都是通過 label Selector 決定的。Service 抽象了對 Pod 的訪問。

默認的 Service ,通過一個集群 IP 獲取 A Record 。但是有時需要返回所有滿足條件的 Pod IP 列表,這時候可以直接使用 Headless Services 。

參考:https://kubernetes.io/

推薦書籍:[kubernetes in action]

隨著微服務的普及,應用之間的通信有了足夠多的成熟方案。

從功能層面來說,對開發者有感知的功能有:

從選型角度會關注以下幾點:

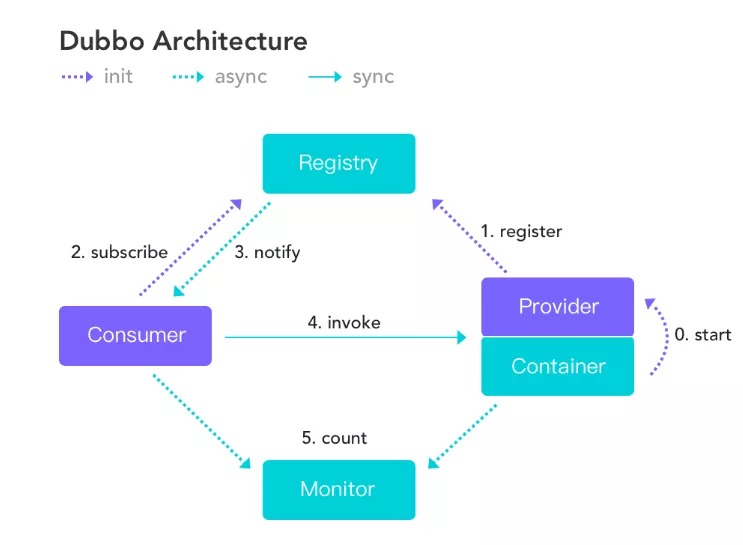

關鍵流程:

關鍵知識點:

備注:Dubbo 和 HSF 的大部分機制都是相似的,所以下面都以 Dubbo 作為方案進行討論。

Spring Cloud 通過 Rest 形式進行網絡調用。應用開發者可以自己編寫暴露 Rest 服務,如 springmvc 。

Spring Cloud 里的服務注冊是應用維度( Eureka ),Client 端和 Server 端通過約定的方式進行通信。

Spring Cloud 提供了一套標準 API ,而其中 Netflix 是其中的佼佼者,對這套 API 進行了實現,對大部分開發者來說,可以回直接依賴和使用 Netflix ,所以可以說是 Netflix 提供成了 Spring Cloud 的核心。但是作為商業公司對開源投入往往會多變,如 Eureka 已經體制維護。

gRPC 是一個基于 HTTP/2 協議設計的 RPC 框架,它采用了 Protobuf 作為 IDL。gRPC 作為端到端的通信方案,可以解決現在的多語言問題。

gRPC 本身不提供服務注冊,服務治理的功能。但現在可以看到 gRpc 有趨勢往這方面擴展的野心。

K8s 體系里暫時沒有公允的通信框架,一般推薦 gRPC 作為 RPC 框架。

K8s 體系的默認情況下, Pod 的 IP 是變化的,所以 Pod 和 Pod 之間需要通信的話,有幾種方式:

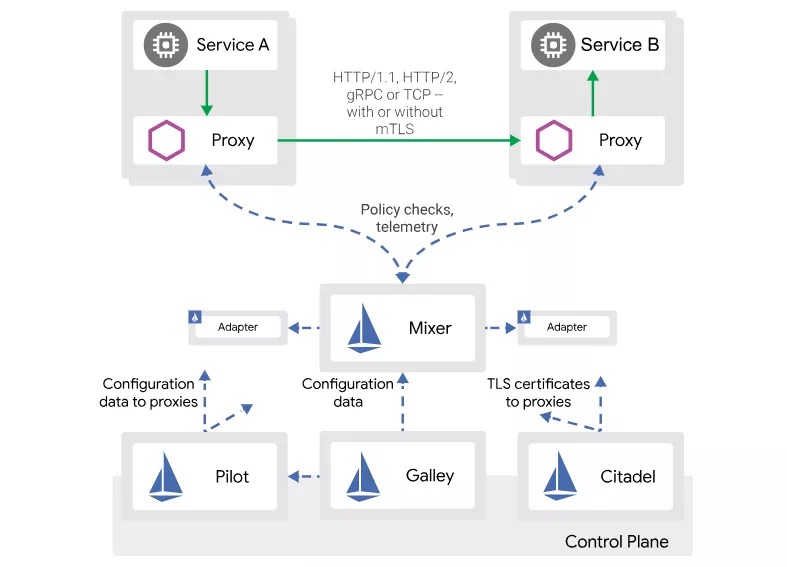

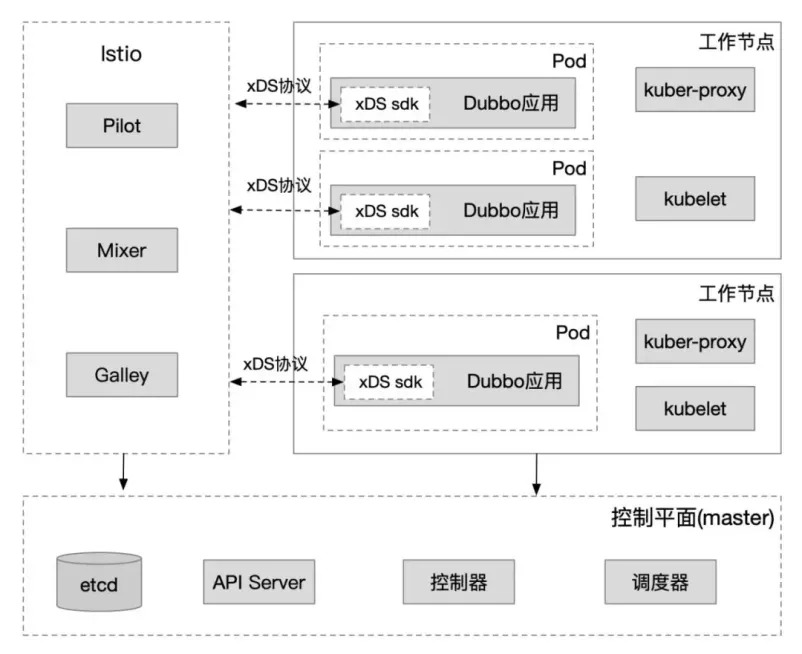

Istio 的控制層會向 K8s 的 Api server 請求并監聽 pod 信息,service 信息等信息。這樣 Istio 中就有了完整的 K8s 集群中的 pod,service 等的完整信息。如果 K8s 集群中有信息變更,Istio 中也可以得到通知并更新對應的信息。

Envoy 作為 Proxy 一個最常見的實現,以 Envoy 作為例子簡單介紹。Envoy 通過查詢文件或管理服務器來動態發現資源。對應的發現服務及其相應的 Api 被稱作 xDS 。協議內容包括 LDS、RDS、CDS 等等。

參考資料:

Service Mesh 介紹:https://www.infoq.cn/article/pattern-service-mesh[Istio]

路由規則:https://istio.io/docs/tasks/traffic-management/request-routing/

備注:上述知識是通過查閱資料( Istio 官網),以及和集團 Service Mesh 同學溝通獲得。如有問題,歡迎指正。

Dubbo 默認是基于 TCP 通信,Spring Cloud 大部分基于 Rest 請求。在阿里云實施商業化過程中,發現大量公司需要 Spring Cloud 應用和 Dubbo 進行通信,社區主要依靠 Dubbo 上增加一層網關來解決。

是否有方案進行統一服務注冊發現,以及服務調用呢?

基礎理論可以參考:

https://yq.aliyun.com/articles/585461

K8s 下 Pod 的 IP 是變化的 (默認),Dubbo 的服務治理高度依賴 IP 。

K8s 的服務注冊通過 Pod 定義完成,服務發現其實是尋找 Pod 的過程。Pod 和應用有一定的對應關系,和 Dubbo 里的接口維度的服務注冊發現模型不是很匹配。

Dubbo 需要進行支持裁剪,Dubbo 的大部分功能都可以交由 sidecar ( proxy )來完成。

如果公司已經在部署 RPC 框架,這時候如果需要實施?Service Mesh ,有什么好的過渡方案嗎?

服務怎么定義呢?需要從應用開發者角度看待怎么定義服務。

服務在功能維度對應某一功能,如查詢已買訂單詳情。在 Dubbo 中,對應某個接口下的方法;在 Spring Cloud 和 gRPC 對應一個 http 請求。

如果從面向函數編程角度,一個服務就是一個 function 。在 Java 語言中,class 是一切編程的基礎,所以將某些服務按照一定的維度進行聚合,放到某個接口中,就成了一個接口包含了很多的服務。

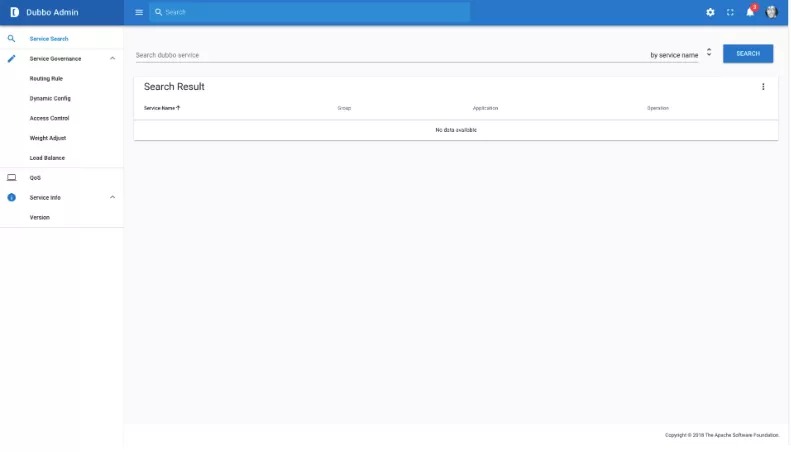

從 Dubbo 角度來解釋下:Dubbo 是面向接口編程的遠程通信,所以 Dubbo 是面向服務集的編程,你如果想調用某個服務,必須通過接口的方式引入,然后調用接口中的某個服務。Dubbo Ops 中提供的服務查詢功能,其實不是查詢單個服務,而是通過查詢接口(服務集)之后獲得具體的方法(服務)。

而在 Spring Cloud 的世界里,服務提供方會將自己的應用信息( Ip+port )注冊成應用下的一個實例,服務消費方和服務提供方按照約定的形式進行 Rest 請求。每個請求對應的也是一個服務。

K8s 里的 Service 其實是對應到一組 pod+port 列表,和 DNS 聯系緊密;用通俗易懂的方式表達:維護了 pod 集合的關系映射。和上面講的服務是屬于不同場景下的兩個概念。

按照這個方式定義服務,服務治理的粒度其實也是按照服務粒度,可以針對每個服務設置超時時間,設置路由規則等等。但是服務注冊的粒度和服務有什么關系呢?

一個應用下包含了很多接口,一個接口下包含了很多服務( Dubbo );或者一個應用包含了很多的服務( Spring Cloud )。分析下應用維度注冊和接口維度注冊的優缺點。會有一篇獨立的文章來闡述應用維度注冊的方案。

優點:

缺點:

優點:

缺點:

目標:

Dubbo 改造成應用維度的服務注冊。(具體不展開,后面文章說明)

Dubbo 實現中,支持將以 Rest 協議進行暴露,并且讓 Spring Cloud 識別。

在 K8s 已經闡述過,下面的內容也是假設一個應用部署在一個容器里,一個容器部署在一個 pod 里。

接下來方案的討論,互相之間其實是有關聯的,如服務治理可能會影響到服務注冊發現,服務查詢也不能依賴于服務注冊的內容。整個設計的過程是不斷優化的過程。下面所說的內容,以 Dubbo 來舉例說明。

Dubbo 原有體系里的服務治理是強依賴于 IP ,當配置了一套服務治理規則的時候,最后都是基于一個或多個 IP 地址。

到 K8s 體系下之后,要考慮的是 Pod 的 IP 不是固定的。所以當前的路由規則不能滿足條件,而且會產生很多規則垃圾數據。K8s 體系下,通過 service 查找 Pod ,是基于 label selector ;通過 deployment 管理 Pod ,其實也是基于 Pod label selector 。所以 pod label selector 是在 K8s 習題中比較通用的解決方案。

以路由規則為例,需要支持一種新的路由規則:label 路由。通過一定條件匹配之后,將結果定位到以 label selector 查詢到的 Pod 列表里,而非原來的 ip 列表。

要支持 label 路由,client 端需要獲取到 client 端自己的 Pod label 信息,還需要獲取到 server pod 列表中每個 Pod 的 label 信息。

Pod 定義環境變量,應用獲取;Dubbo 提供對環境變量讀取的支持,Pod 中需要按照 Dubbo 定義的環境變量設置具體的 pod 信息。

通過 Downward API 傳遞 Pod 信息;Dubbo 需要提供對 Downward 的目錄讀取,Pod 中需要定制 downward 的對應配置。

通過調用其他 Pod 的服務獲取;依賴于應用能獲取自身的 Pod 信息,同時將自身的 Pod 信息暴露成服務( rest 或 dubbo 協議)。client 端通過調用對用的 Pod 獲取到對應 Pod 的完整信息。

K8s 體系下,RPC 服務發現有以下幾種方式:

注冊機制:將 IP 寫入注冊中心,用心跳保持連接;當心跳停止,從注冊中心刪除;

利用 Service+DNS :新建一個 Service ,可以通過標簽選擇到一組 Pod 列表,這個 Service 對應一個不變的集群 IP ;Client 端通過 DNS 方式或者直接訪問集群 IP 。這個集群 IP ,約等于實現了負載均衡 ( iptable 方式);

利用 headless service(DNS) :headless service 和上面的 service 的區別是,它不提供集群 IP ,通過主機名的形式獲取一組 IP 列表,Client 端自己決定訪問哪個 Pod ;

通過拿到 Server 端的 IP 或者 host ,Client 端就可以發起? http 或者其他協議的請求。

下面介紹符合 Dubbo 的可行方案:

這是最簡單的方式,Dubbo 本身不需要做任何改造。帶來的問題是增加了 Zookeeper 的維護,同時這個方案很不云原生,和 K8s 的體系沒有任何關系。

上面方案是將 ZooKeeper 作為注冊中心,那么是否可以將 K8s 里 service 作為注冊中心呢?Dubbo 里每個接口去建立一個 service ,每個應用實例啟動過程中去更新 Endpoint 信息,建立 Service-> Endpoint-> IP 列表的關系。

這種方案中 K8s service 的定義被改造了,而且定義了過多的 service ,service 的維護管理是個難題。

在傳統的 RPC 領域,服務分成服務注冊和服務發現。在 K8s 領域 pod 和應用是一對一的關系,K8s 本身就提供了 pod 查找的能力,所以一定程度上服務注冊其實可以不存在,而只需要服務發現。但是這個其實需要一個前提:

Dubbo 需要將服務注冊發現的粒度改造成應用維度。> 在運維層面,將 app=xxx (應用名)寫入到 pod 的 label 中。

如果 K8s service 提供了cluster ip ,那么 Dubbo 只負責調用該集群 Ip ,路由和負載均衡的邏輯則交給了 K8s 的 proxy 來完成。此方案削減了 Dubbo 的核心能力。接下來討論 headless service 提供的能力。

通過請求 <service>.<ns>.svc.<zone>. ?IN A ?的方式發起請求獲取 IP 列表,但是需要輪詢方式不斷獲取更新的 IP 列表。

服務治理相關的功能,需要在上述服務治理部分中獨立支持。

參考:https://github.com/kubernetes/dns/blob/master/docs/specification.md#24---records-for-a-headless-service

Pod 的容器中部署的 Dubbo 應用,服務注冊流程可以直接刪除,服務發現功能通過和 Api Server 進行交互,獲取 Pod 和 service 信息,同時 watch pod 和service 的變更。通過這種方式之后,服務治理相關的信息也可以通過 Api Server 直接獲取。

Dubbo 可以直接使用指定 ip+端口 的方式調用同一個 pod 下 Envoy ?(也可能是同一個node的Envoy)。Dubbo 將路由規則,負載均衡,熔斷等功能交給 Istio 和 Envoy。Envoy 需要支持 Dubbo 協議的轉發。

所以 Dubbo 需要完成兩個事情:本地 IP 直連(現有功能), 多余功能裁剪(暫未實現)。

所有的服務注冊通過k8s的機制完成,所有的服務發現通過 Headless service 完成。sidecar 在創建過程中,需要對原有的 K8s service 進行 update;

Istio 提供了跨集群和云上云下的解決方案, kubeFed 作為 K8s 的跨集群解決方案也能起到一定作用。

這個課題的復雜度更加高,心中有了一些答案,期望大家通過上文也有一定的思考。

拋出三種方式,供大家思考。

Dubbo 原有的服務查詢是針對接口的查詢,每個接口會有版本號和組別。接口名+版本號+組別確定唯一的服務集合,這個服務集下有對應的服務提供者和服務消費者(接口級依賴),服務提供者是一組 ip+port 列表,服務消費者也是一組 ip+port 列表。

當做了改造成應用級別的服務注冊或者直接使用 K8s 自帶的 Pod 發現機制的話,需要做一些改造,這部分改造,和前面提到的一樣,放到其他文章里單獨說明。

和 Spring Cloud 類似,支持應用維度的查詢。查詢到具體應用之后,應用詳情下包含了 ip+port 列表,每個 ip+port 其實就是一個應用的實例。點擊開每個應用實例,可以查看每個應用的詳細信息,詳細信息包含了該實例提供了哪些服務。

在原來只支持應用查詢的基礎上,增加一步:支持查詢某個接口對應的應用列表,而大部分接口只屬于一個應用。

再點擊應用列表下具體的應用之后,會跳到應用詳情。

上述討論的是開源的方案,所以相對歷史包袱比較少。對一些大公司想從原有的 RPC 方案切換到云原生的支持,需要考慮更多兼容性和性能,需要付出更大的代價。

云原生的趨勢已經勢不可擋,在 RPC 領域究竟哪種方案最終能夠勝出,現在還言之過早。我相信 Service Mesh 和傳統的 RPC ?(Dubbo/ gRPC)? 都會有自己的一席之地,一切讓時間給我們答案吧。

“ 阿里巴巴云原生微信公眾號(ID:Alicloudnative)關注微服務、Serverless、容器、Service Mesh等技術領域、聚焦云原生流行技術趨勢、云原生大規模的落地實踐,做最懂云原生開發者的技術公眾號。”

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。