您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章給大家分享的是有關關于Python3爬蟲中HTTP的基本原理分析的內容。小編覺得挺實用的,因此分享給大家做個參考。一起跟隨小編過來看看吧。

詳細了解HTTP的基本原理,了解在瀏覽器中敲入URL到獲取網頁內容之間發生了什么。了解了這些內容,有助于我們進一步了解爬蟲的基本原理。

1. URI和URL

這里我們先了解一下URI和URL,URI的全稱為Uniform Resource Identifier,即統一資源標志符,URL的全稱為Universal Resource Locator,即統一資源定位符。

舉例來說,https://github.com/favicon.ico是GitHub的網站圖標鏈接,它是一個URL,也是一個URI。即有這樣的一個圖標資源,我們用URL/URI來唯一指定了它的訪問方式,這其中包括了訪問協議https、訪問路徑(/即根目錄)和資源名稱favicon.ico。通過這樣一個鏈接,我們便可以從互聯網上找到這個資源,這就是URL/URI。

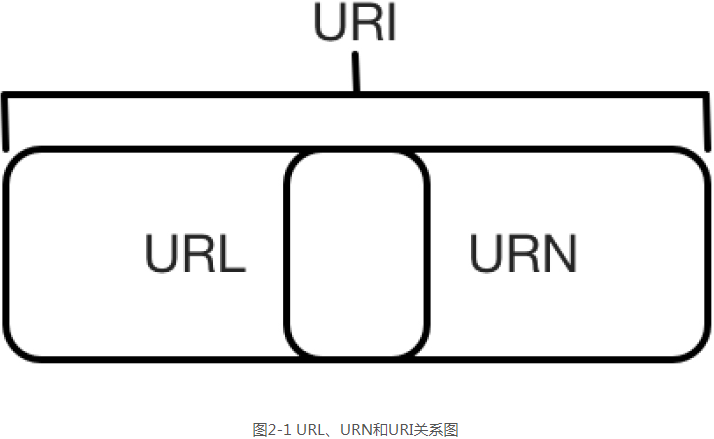

URL是URI的子集,也就是說每個URL都是URI,但不是每個URI都是URL。那么,怎樣的URI不是URL呢?URI還包括一個子類叫作URN,它的全稱為Universal Resource Name,即統一資源名稱。URN只命名資源而不指定如何定位資源,比如urn:isbn:0451450523指定了一本書的ISBN,可以唯一標識這本書,但是沒有指定到哪里定位這本書,這就是URN。URL、URN和URI的關系可以用圖2-1表示。

但是在目前的互聯網中,URN用得非常少,所以幾乎所有的URI都是URL,一般的網頁鏈接我們既可以稱為URL,也可以稱為URI,我個人習慣稱為URL。

2. 超文本

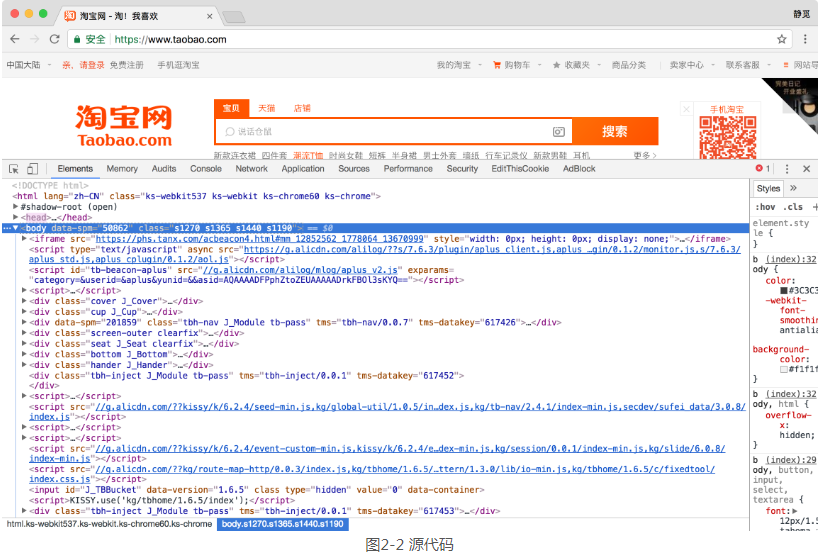

接下來,我們再了解一個概念——超文本,其英文名稱叫作hypertext,我們在瀏覽器里看到的網頁就是超文本解析而成的,其網頁源代碼是一系列HTML代碼,里面包含了一系列標簽,比如img顯示圖片,p指定顯示段落等。瀏覽器解析這些標簽后,便形成了我們平常看到的網頁,而網頁的源代碼HTML就可以稱作超文本。

例如,我們在Chrome瀏覽器里面打開任意一個頁面,如淘寶首頁,右擊任一地方并選擇“檢查”項(或者直接按快捷鍵F12),即可打開瀏覽器的開發者工具,這時在Elements選項卡即可看到當前網頁的源代碼,這些源代碼都是超文本,如圖2-2所示。

3. HTTP和HTTPS

在淘寶的首頁https://www.taobao.com/中,URL的開頭會有http或https,這就是訪問資源需要的協議類型。有時,我們還會看到ftp、sftp、smb開頭的URL,它們都是協議類型。在爬蟲中,我們抓取的頁面通常就是http或https協議的,這里首先了解一下這兩個協議的含義。

HTTP的全稱是Hyper Text Transfer Protocol,中文名叫作超文本傳輸協議。HTTP協議是用于從網絡傳輸超文本數據到本地瀏覽器的傳送協議,它能保證高效而準確地傳送超文本文檔。HTTP由萬維網協會(World Wide Web Consortium)和Internet工作小組IETF(Internet Engineering Task Force)共同合作制定的規范,目前廣泛使用的是HTTP 1.1版本。

HTTPS的全稱是Hyper Text Transfer Protocol over Secure Socket Layer,是以安全為目標的HTTP通道,簡單講是HTTP的安全版,即HTTP下加入SSL層,簡稱為HTTPS。

HTTPS的安全基礎是SSL,因此通過它傳輸的內容都是經過SSL加密的,它的主要作用可以分為兩種。

建立一個信息安全通道來保證數據傳輸的安全。

確認網站的真實性,凡是使用了HTTPS的網站,都可以通過點擊瀏覽器地址欄的鎖頭標志來查看網站認證之后的真實信息,也可以通過CA機構頒發的安全簽章來查詢。

現在越來越多的網站和App都已經向HTTPS方向發展,例如:

蘋果公司強制所有iOS App在2017年1月1日前全部改為使用HTTPS加密,否則App就無法在應用商店上架;

谷歌從2017年1月推出的Chrome 56開始,對未進行HTTPS加密的網址鏈接亮出風險提示,即在地址欄的顯著位置提醒用戶“此網頁不安全”;

騰訊微信小程序的官方需求文檔要求后臺使用HTTPS請求進行網絡通信,不滿足條件的域名和協議無法請求。

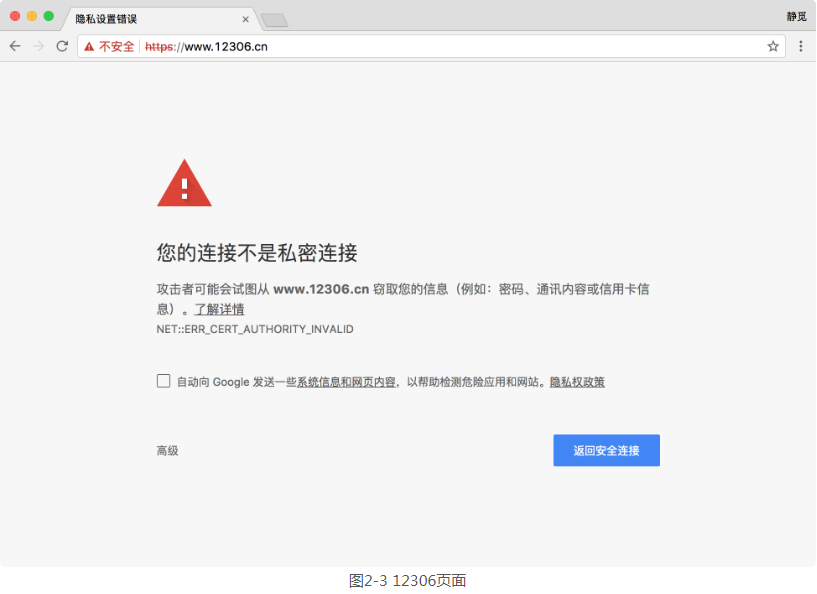

而某些網站雖然使用了HTTPS協議,但還是會被瀏覽器提示不安全,例如我們在Chrome瀏覽器里面打開12306,鏈接為:https://www.12306.cn/,這時瀏覽器就會提示“您的連接不是私密連接”這樣的話,如圖2-3所示。

這是因為12306的CA證書是中國鐵道部自行簽發的,而這個證書是不被CA機構信任的,所以這里證書驗證就不會通過而提示這樣的話,但是實際上它的數據傳輸依然是經過SSL加密的。如果要爬取這樣的站點,就需要設置忽略證書的選項,否則會提示SSL鏈接錯誤。

4. HTTP請求過程

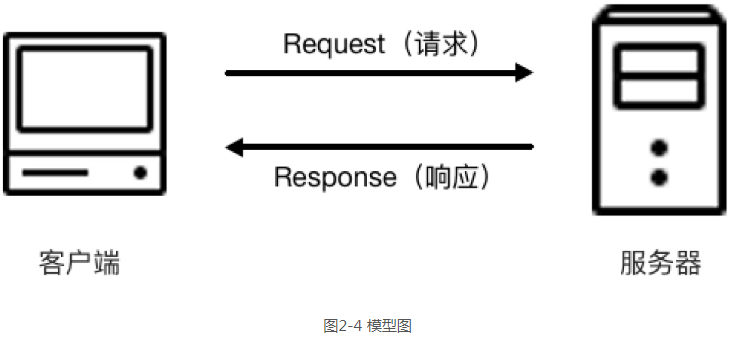

我們在瀏覽器中輸入一個URL,回車之后便會在瀏覽器中觀察到頁面內容。實際上,這個過程是瀏覽器向網站所在的服務器發送了一個請求,網站服務器接收到這個請求后進行處理和解析,然后返回對應的響應,接著傳回給瀏覽器。響應里包含了頁面的源代碼等內容,瀏覽器再對其進行解析,便將網頁呈現了出來,模型如圖2-4所示。

此處客戶端即代表我們自己的PC或手機瀏覽器,服務器即要訪問的網站所在的服務器。

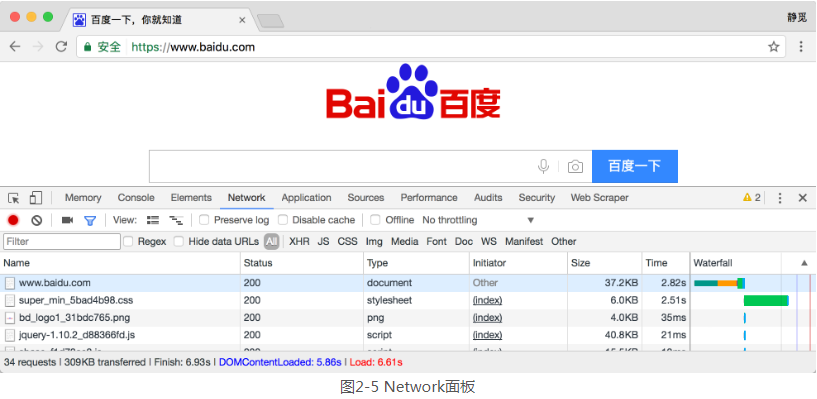

為了更直觀地地說明這個過程,這里用Chrome瀏覽器的開發者模式下的Network監聽組件來做下演示,它可以顯示訪問當前請求網頁時發生的所有網絡請求和響應。

打開Chrome瀏覽器,右擊并選擇“檢查”項,即可打開瀏覽器的開發者工具。這里訪問百度http://www.baidu.com/,輸入該URL后回車,觀察這個過程中發生了怎樣的網絡請求。可以看到,在Network頁面下方出現了一個個的條目,其中一個條目就代表一次發送請求和接收響應的過程,如圖2-5所示。

我們先觀察第一個網絡請求,即www.baidu.com。

其中各列的含義如下。

第一列Name:請求的名稱,一般會將URL的最后一部分內容當作名稱。

第二列Status:響應的狀態碼,這里顯示為200,代表響應是正常的。通過狀態碼,我們可以判斷發送了請求之后是否得到了正常的響應。

第三列Type:請求的文檔類型。這里為document,代表我們這次請求的是一個HTML文檔,內容就是一些HTML代碼。

第四列Initiator:請求源。用來標記請求是由哪個對象或進程發起的。

第五列Size:從服務器下載的文件和請求的資源大小。如果是從緩存中取得的資源,則該列會顯示from cache。

第六列Time:發起請求到獲取響應所用的總時間。

第七列Waterfall:網絡請求的可視化瀑布流。

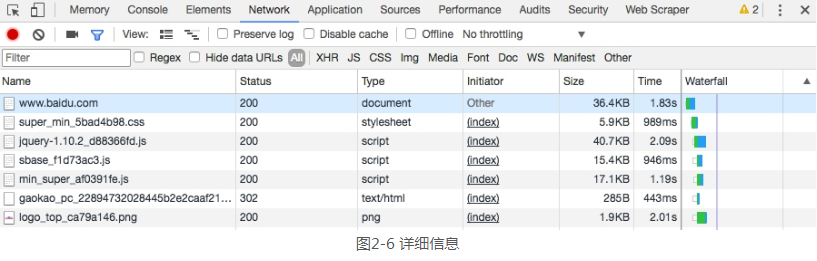

點擊這個條目,即可看到更詳細的信息,如圖2-6所示。

首先是General部分,Request URL為請求的URL,Request Method為請求的方法,Status Code為響應狀態碼,Remote Address為遠程服務器的地址和端口,Referrer Policy為Referrer判別策略。

再繼續往下看,可以看到,有Response Headers和Request Headers,這分別代表響應頭和請求頭。請求頭里帶有許多請求信息,例如瀏覽器標識、Cookies、Host等信息,這是請求的一部分,服務器會根據請求頭內的信息判斷請求是否合法,進而作出對應的響應。圖中看到的Response Headers就是響應的一部分,例如其中包含了服務器的類型、文檔類型、日期等信息,瀏覽器接受到響應后,會解析響應內容,進而呈現網頁內容。

下面我們分別來介紹一下請求和響應都包含哪些內容。

5. 請求

請求,由客戶端向服務端發出,可以分為4部分內容:請求方法(Request Method)、請求的網址(Request URL)、請求頭(Request Headers)、請求體(Request Body)。

(1) 請求方法

常見的請求方法有兩種:GET和POST。

在瀏覽器中直接輸入URL并回車,這便發起了一個GET請求,請求的參數會直接包含到URL里。例如,在百度中搜索Python,這就是一個GET請求,鏈接為https://www.baidu.com/s?wd=Python,其中URL中包含了請求的參數信息,這里參數wd表示要搜尋的關鍵字。POST請求大多在表單提交時發起。比如,對于一個登錄表單,輸入用戶名和密碼后,點擊“登錄”按鈕,這通常會發起一個POST請求,其數據通常以表單的形式傳輸,而不會體現在URL中。

GET和POST請求方法有如下區別。

GET請求中的參數包含在URL里面,數據可以在URL中看到,而POST請求的URL不會包含這些數據,數據都是通過表單形式傳輸的,會包含在請求體中。

GET請求提交的數據最多只有1024字節,而POST方式沒有限制。

一般來說,登錄時,需要提交用戶名和密碼,其中包含了敏感信息,使用GET方式請求的話,密碼就會暴露在URL里面,造成密碼泄露,所以這里最好以POST方式發送。上傳文件時,由于文件內容比較大,也會選用POST方式。

我們平常遇到的絕大部分請求都是GET或POST請求,另外還有一些請求方法,如GET、HEAD、POST、PUT、DELETE、OPTIONS、CONNECT、TRACE等,我們簡單將其總結為表2-1。

本表參考:http://www.runoob.com/http/http-methods.html。

(2) 請求的網址

請求的網址,即統一資源定位符URL,它可以唯一確定我們想請求的資源。

(3) 請求頭

請求頭,用來說明服務器要使用的附加信息,比較重要的信息有Cookie、Referer、User-Agent等。下面簡要說明一些常用的頭信息。

Accept:請求報頭域,用于指定客戶端可接受哪些類型的信息。

Accept-Language:指定客戶端可接受的語言類型。

Accept-Encoding:指定客戶端可接受的內容編碼。

Host:用于指定請求資源的主機IP和端口號,其內容為請求URL的原始服務器或網關的位置。從HTTP 1.1版本開始,請求必須包含此內容。

Cookie:也常用復數形式 Cookies,這是網站為了辨別用戶進行會話跟蹤而存儲在用戶本地的數據。它的主要功能是維持當前訪問會話。例如,我們輸入用戶名和密碼成功登錄某個網站后,服務器會用會話保存登錄狀態信息,后面我們每次刷新或請求該站點的其他頁面時,會發現都是登錄狀態,這就是Cookies的功勞。Cookies里有信息標識了我們所對應的服務器的會話,每次瀏覽器在請求該站點的頁面時,都會在請求頭中加上Cookies并將其發送給服務器,服務器通過Cookies識別出是我們自己,并且查出當前狀態是登錄狀態,所以返回結果就是登錄之后才能看到的網頁內容。

Referer:此內容用來標識這個請求是從哪個頁面發過來的,服務器可以拿到這一信息并做相應的處理,如作來源統計、防盜鏈處理等。

User-Agent:簡稱UA,它是一個特殊的字符串頭,可以使服務器識別客戶使用的操作系統及版本、瀏覽器及版本等信息。在做爬蟲時加上此信息,可以偽裝為瀏覽器;如果不加,很可能會被識別出為爬蟲。

Content-Type:也叫互聯網媒體類型(Internet Media Type)或者MIME類型,在HTTP協議消息頭中,它用來表示具體請求中的媒體類型信息。例如,text/html代表HTML格式,image/gif代表GIF圖片,application/json代表JSON類型,更多對應關系可以查看此對照表:http://tool.oschina.net/commons。

因此,請求頭是請求的重要組成部分,在寫爬蟲時,大部分情況下都需要設定請求頭。

(4) 請求體

請求體一般承載的內容是POST請求中的表單數據,而對于GET請求,請求體則為空。

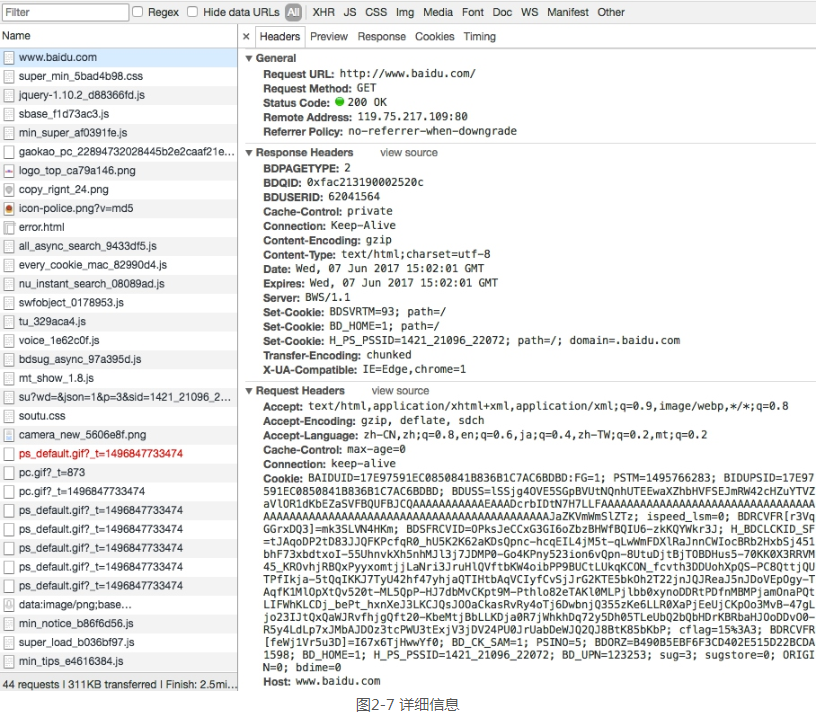

例如,這里我登錄GitHub時捕獲到的請求和響應如圖2-7所示。

登錄之前,我們填寫了用戶名和密碼信息,提交時這些內容就會以表單數據的形式提交給服務器,此時需要注意Request Headers中指定Content-Type為application/x-www-form-urlencoded。只有設置Content-Type為application/x-www-form-urlencoded,才會以表單數據的形式提交。另外,我們也可以將Content-Type設置為application/json來提交JSON數據,或者設置為multipart/form-data來上傳文件。

表2-2列出了Content-Type和POST提交數據方式的關系。

在爬蟲中,如果要構造POST請求,需要使用正確的Content-Type,并了解各種請求庫的各個參數設置時使用的是哪種Content-Type,不然可能會導致POST提交后無法正常響應。

6. 響應

響應,由服務端返回給客戶端,可以分為三部分:響應狀態碼(Response Status Code)、響應頭(Response Headers)和響應體(Response Body)。

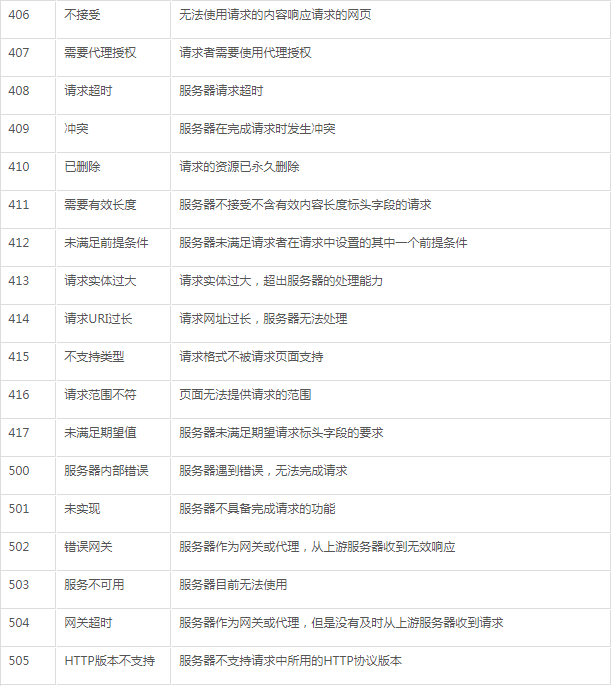

(1) 響應狀態碼

響應狀態碼表示服務器的響應狀態,如200代表服務器正常響應,404代表頁面未找到,500代表服務器內部發生錯誤。在爬蟲中,我們可以根據狀態碼來判斷服務器響應狀態,如狀態碼為200,則證明成功返回數據,再進行進一步的處理,否則直接忽略。表2-3列出了常見的錯誤代碼及錯誤原因。

(2) 響應頭

響應頭包含了服務器對請求的應答信息,如Content-Type、Server、Set-Cookie等。下面簡要說明一些常用的頭信息。

Date:標識響應產生的時間。

Last-Modified:指定資源的最后修改時間。

Content-Encoding:指定響應內容的編碼。

Server:包含服務器的信息,比如名稱、版本號等。

Content-Type:文檔類型,指定返回的數據類型是什么,如text/html代表返回HTML文檔,application/x-javascript則代表返回JavaScript文件,image/jpeg則代表返回圖片。

Set-Cookie:設置Cookies。響應頭中的Set-Cookie告訴瀏覽器需要將此內容放在Cookies中,下次請求攜帶Cookies請求。

Expires:指定響應的過期時間,可以使代理服務器或瀏覽器將加載的內容更新到緩存中。如果再次訪問時,就可以直接從緩存中加載,降低服務器負載,縮短加載時間。

(3) 響應體

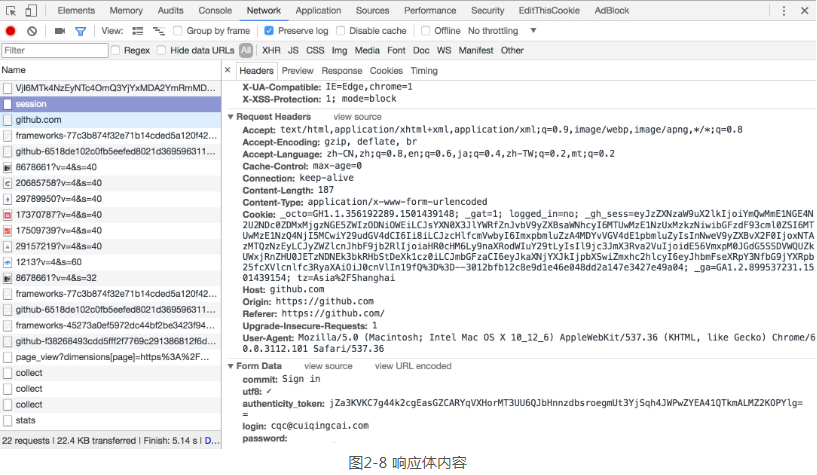

最重要的當屬響應體的內容了。響應的正文數據都在響應體中,比如請求網頁時,它的響應體就是網頁的HTML代碼;請求一張圖片時,它的響應體就是圖片的二進制數據。我們做爬蟲請求網頁后,要解析的內容就是響應體,如圖2-8所示。

在瀏覽器開發者工具中點擊Preview,就可以看到網頁的源代碼,也就是響應體的內容,它是解析的目標。

在做爬蟲時,我們主要通過響應體得到網頁的源代碼、JSON數據等,然后從中做相應內容的提取。

感謝各位的閱讀!關于關于Python3爬蟲中HTTP的基本原理分析就分享到這里了,希望以上內容可以對大家有一定的幫助,讓大家可以學到更多知識。如果覺得文章不錯,可以把它分享出去讓更多的人看到吧!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。