您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

ELK系統在安裝完成后需要處理相關的日志文件,本文主要對nginx日志文件進行處理并進行可視化操作,來滿足日常的業務需求,長話短說,接下來介紹我的環境

具體的網絡拓撲圖如下:

具體配置如下:

| server | OS | Version | IP | 備注 |

| logstash | CentOS release 6.4 (Final) | logstash 2.2.2 | 192.168.180.2 | logstash客戶端用來收集日志 |

| elasticsearch | CentOS release 6.4 (Final) | elasticsearch 2.2.1 | 192.168.180.3 | |

| kibana | CentOS release 6.4 (Final) | kibana 4.4.2 | 192.168.180.3 |

具體步驟如下:

(一)配置nginx服務器日志的格式( log_format)為統一格式:

[root@ittestserver1 local]# vim /usr/local/nginx2/conf/nginx.conf

http {

include mime.types;

default_type application/octet-stream;

#include proxy.conf;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

access_log logs/access.log main;

access_log on;(二)安裝配置logstash:

1, 安裝步驟省略具體參考上篇文章

2,配置如下:

[root@ittestserver1 local]# vim /usr/local/logstash/etc/nginx-access0518.conf

input {

file {

path => "/usr/local/nginx2/logs/access.log"

type => "nginx-access"

start_position => "beginning"

sincedb_path => "/usr/local/logstash/sincedb"

codec => "json"

}

}

filter {

if [type] == "nginx-access" {

geoip {

source => "clientip"

target => "geoip"

database => "/usr/local/logstash/etc/GeoLiteCity.dat"

add_field => [ "[geoip][coordinates]", "%{[geoip][longitude]}" ]

add_field => [ "[geoip][coordinates]", "%{[geoip][latitude]}" ]

}

mutate {

convert => [ "[geoip][coordinates]", "float"]

}

}

}

output {

if [type] == "nginx-access" {

elasticsearch {

hosts => ["192.168.180.3:9200"]

manage_template => true

index => "logstash-nginx-access-%{+YYYY-MM}"

}

}

}具體解釋如下:

Logstash 分為 Input、Output、Filter、Codec 等多種plugins。

Input:數據的輸入源也支持多種插件,如elk官網的beats、file、graphite、http、kafka、redis、exec等等等、、、

Output:數據的輸出目的也支持多種插件,如本文的elasticsearch,當然這可能也是最常用的一種輸出。以及exec、stdout終端、graphite、http、zabbix、nagios、redmine等等、、、

Filter:使用過濾器根據日志事件的特征,對數據事件進行處理過濾后,在輸出。支持grok、date、geoip、mutate、ruby、json、kv、csv、checksum、dns、drop、xml等等、、

Codec:編碼插件,改變事件數據的表示方式,它可以作為對輸入或輸出運行該過濾。和其它產品結合,如rubydebug、graphite、fluent、nmap等等。

具體以上插件的細節可以去官網,介紹的挺詳細的。下面說下該篇中的配置文件的含義:

input段:

file:使用file 作為輸入源

path: 日志的路徑,支持/var/log*.log,及[ "/var/log/messages", "/var/log/*.log" ] 格式

start_position: 從文件的開始讀取事件。另外還有end參數

filter段:

grok:數據結構化轉換工具

match:匹配條件格式,將nginx日志作為message變量,并應用grok條件NGINXACCESS進行轉換

geoip:該過濾器從geoip中匹配ip字段,顯示該ip的地理位置

source:ip來源字段,這里我們選擇的是日志文件中的最后一個字段,如果你的是默認的nginx日志,選擇第一個字段即可

target:指定插入的logstash字斷目標存儲為geoip

database:geoip數據庫的存放路徑

add_field: 增加的字段,坐標經度

add_field: 增加的字段,坐標緯度

mutate: 數據的修改、刪除、型轉換

convert: 將坐標轉為float類型

convert: http的響應代碼字段轉換成 int

convert: http的傳輸字節轉換成int

replace: 替換一個字段

remove_field: 移除message 的內容,因為數據已經過濾了一份,這里不必在用到該字段了。不然會相當于存兩份

date: 時間處理,該插件很實用,主要是用你日志文件中事件的事件來對timestamp進行轉換,導入老的數據必備!在這里曾讓我困惑了很久哦。別再掉坑了

match:匹配到timestamp字段后,修改格式為dd/MMM/yyyy:HH:mm:ss Z

mutate:數據修改

remove_field: 移除timestamp字段。

output段:

elasticsearch:輸出到es中

host: es的主機ip+端口或者es 的FQDN+端口

index: 為日志創建索引logstash-nginx-access-*,這里也就是kibana那里添加索引時的名稱

3,創建logstash配置文件之后,我們還要去建立grok使用的表達式,因為logstash 的配置文件里定義的使用轉換格式語法,先去logstash的安裝目錄,默認安裝位置:/usr/local/logstash/下,在該位置創建一個目錄patterns:

[root@ittestserver1 local]# mkdir -pv /usr/local/logstash/patterns

NGUSERNAME [a-zA-Z\.\@\-\+_%]+

NGUSER %{NGUSERNAME}

NGINXACCESS %{IPORHOST:remote_addr} - - \[%{HTTPDATE:time_local}\] "%{WORD:method} %{URIPATHPARAM:request} HTTP/% {NUMBER:httpversion}" %{INT:status} %{INT:body_bytes_sent} %{QS:http_referer} %{QS:http_user_agent4,測試下腳步是否成功并啟動該服務,服務啟動后會一直刷日志。

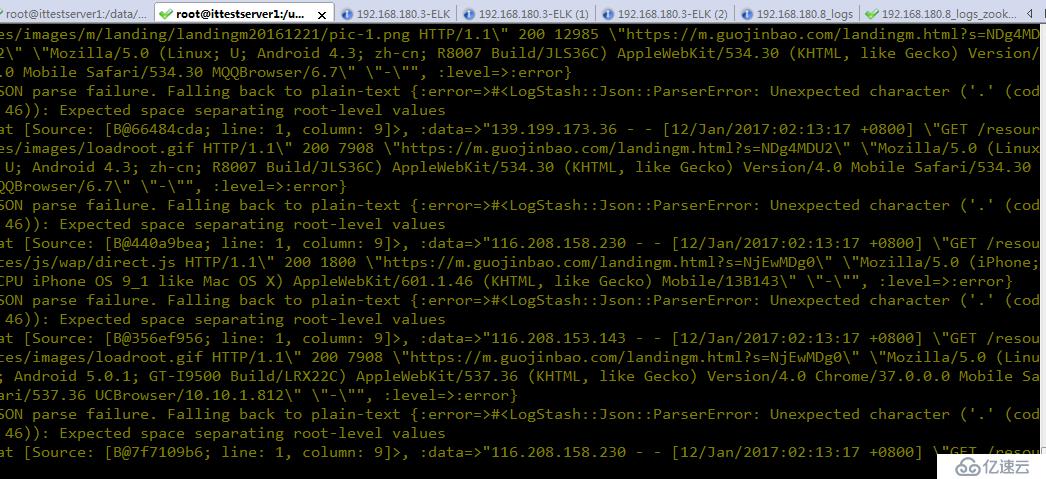

[root@ittestserver1 log]# /usr/local/logstash/bin/logstash -t -f /usr/local/logstash/etc/nginx-access0518.conf

Configuration OK

[root@ittestserver1 log]# /usr/local/logstash/bin/logstash -f /usr/local/logstash/etc/nginx-access0518.conf

nux; Android 5.1.1; R7Plusm Build/LMY47V) AppleWebKit/537.36 (KHTML, like Gecko) Version/4.0 Chrome/37.0.0.0 Mobile MQQBrowser/6.9 TBS/036906 Safari/537.36 hsp\" \"-\"", :level=>:error}

JSON parse failure. Falling back to plain-text {:error=>#<LogStash::Json::ParserError: Unexpected character ('.' (code 46)): Expected space separating root-level values

at [Source: [B@2b2cea68; line: 1, column: 9]>, :data=>"175.155.181.151 - - [12/Jan/2017:01:28:05 +0800] \"GET /resources/p_w_picpaths/m/landing/landingm20161221/header.png HTTP/1.1\" 200 233816 \"https://m.guojinbao.com/landingm.html?s=NDg4MDU2\" \"Mozilla/5.0 (iPhone; CPU iPhone OS 9_1 like Mac OS X) AppleWebKit/601.1.46 (KHTML, like Gecko) Mobile/13B143\" \"-\"", :level=>:error}

JSON parse failure. Falling back to plain-text {:error=>#<LogStash::Json::ParserError: Unexpected character ('.' (code 46)): Expected space separating root-level values

at [Source: [B@7788367a; line: 1, column: 8]>, :data=>"223.67.223.215 - - [12/Jan/2017:01:28:05 +0800] \"GET /resources/js/Crypto.js HTTP/1.1\" 200 8703 \"https://m.guojinbao.com/landingm.html?s=MzIxODQ=\" \"Mozilla/5.0 (Linux; Android 5.1.1; R7Plusm Build/LMY47V) AppleWebKit/537.36 (KHTML, like Gecko) Version/4.0 Chrome/37.0.0.0 Mobile MQQBrowser/6.9 TBS/036906 Safari/537.36 hsp\" \"-\"", :level=>:error}

JSON parse failure. Falling back to plain-text {:error=>#<LogStash::Json::ParserError: Unexpected character ('.' (code 46)): Expected space separating root-level values

at [Source: [B@6297d46d; line: 1, column: 8]>, :data=>"223.67.223.215 - - [12/Jan/2017:01:28:05 +0800] \"GET /resources/p_w_picpaths/m/landing/landingm20161221/btn1.png HTTP/1.1\" 200 10194 \"https://m.guojinbao.com/resources/css/landingm20161221.css\" \"Mozilla/5.0 (Linux; Android 5.1.1; R7Plusm Build/LMY47V) AppleWebKit/537.36 (KHTML, like Gecko) Version/4.0 Chrome/37.0.0.0 Mobile MQQBrowser/6.9 TBS/036906

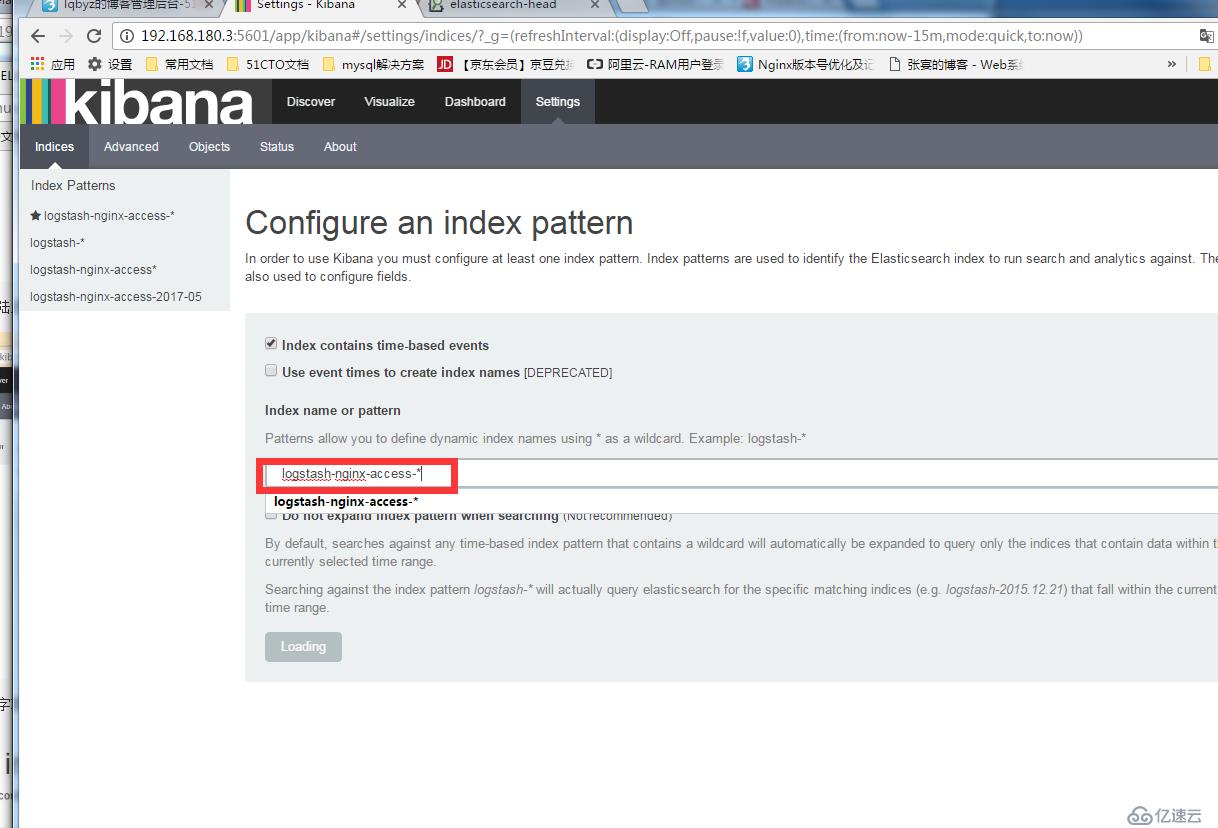

(三)kibana配置

(1)登錄192.168.180.3:5601登錄kibana

(2),添加一個索引,這個索引的名字就是之前導入的ES中的那個,本文中是logstash-nginx-access-*。

查看索引,目前有三個,設置為加星,即是discover默認突出顯示的。

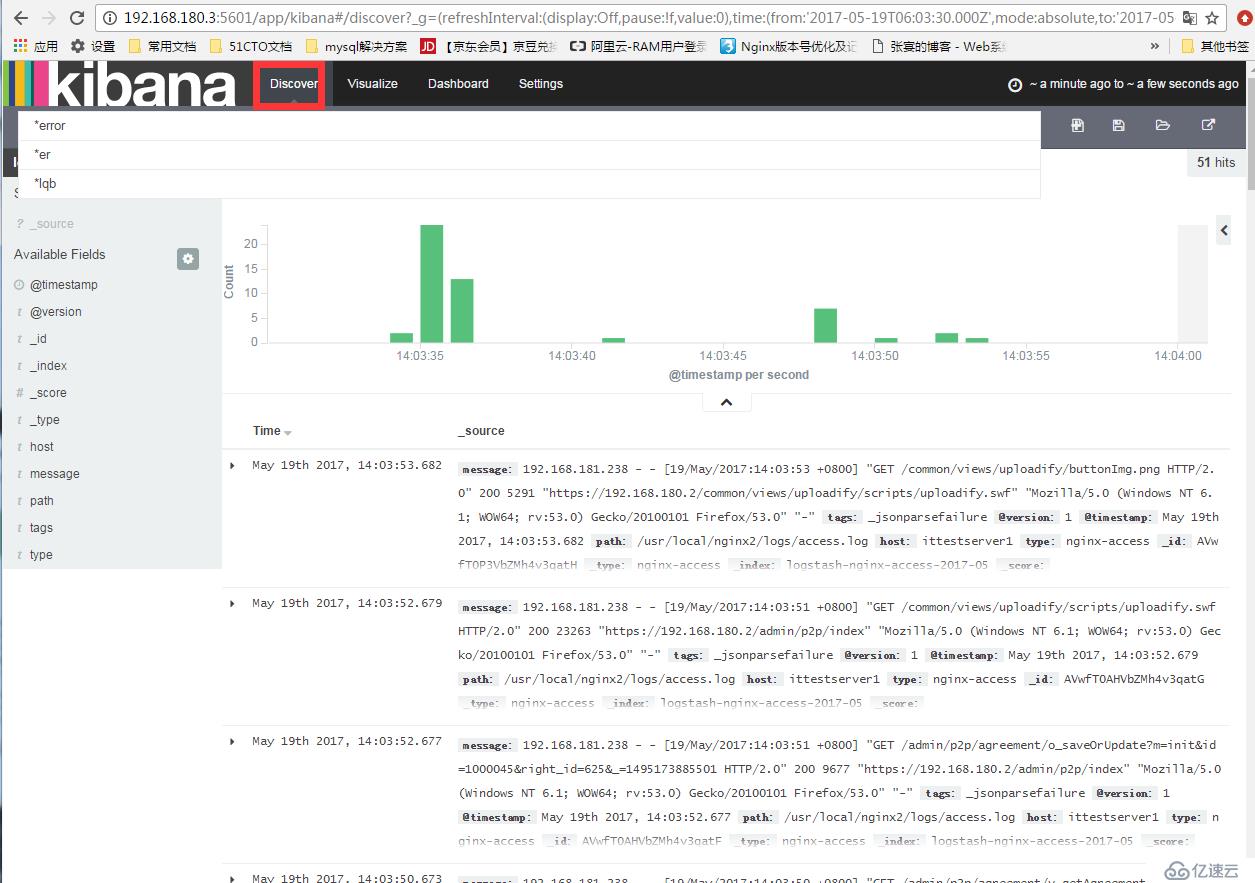

(3)點擊discover既可以看到我們所導入的日志數據了,

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。