溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

本文實例為大家分享了TensorFlow實現卷積神經網絡的具體代碼,供大家參考,具體內容如下

代碼(源代碼都有詳細的注釋)和數據集可以在github下載:

# -*- coding: utf-8 -*-

'''卷積神經網絡測試MNIST數據'''

#########導入MNIST數據########

from tensorflow.examples.tutorials.mnist import input_data

import tensorflow as tf

mnist = input_data.read_data_sets('MNIST_data/', one_hot=True)

# 創建默認InteractiveSession

sess = tf.InteractiveSession()

#########卷積網絡會有很多的權重和偏置需要創建,先定義好初始化函數以便復用########

# 給權重制造一些隨機噪聲打破完全對稱(比如截斷的正態分布噪聲,標準差設為0.1)

def weight_variable(shape):

initial = tf.truncated_normal(shape, stddev=0.1)

return tf.Variable(initial)

# 因為我們要使用ReLU,也給偏置增加一些小的正值(0.1)用來避免死亡節點(dead neurons)

def bias_variable(shape):

initial = tf.constant(0.1, shape=shape)

return tf.Variable(initial)

########卷積層、池化層接下來重復使用的,分別定義創建函數########

# tf.nn.conv2d是TensorFlow中的2維卷積函數

def conv2d(x, W):

return tf.nn.conv2d(x, W, strides=[1, 1, 1, 1], padding='SAME')

# 使用2*2的最大池化

def max_pool_2x2(x):

return tf.nn.max_pool(x, ksize=[1, 2, 2, 1],strides=[1, 2, 2, 1], padding='SAME')

########正式設計卷積神經網絡之前先定義placeholder########

# x是特征,y_是真實label。將圖片數據從1D轉為2D。使用tensor的變形函數tf.reshape

x = tf.placeholder(tf.float32, shape=[None, 784])

y_ = tf.placeholder(tf.float32, shape=[None, 10])

x_image = tf.reshape(x,[-1,28,28,1])

########設計卷積神經網絡########

# 第一層卷積

# 卷積核尺寸為5*5,1個顏色通道,32個不同的卷積核

W_conv1 = weight_variable([5, 5, 1, 32])

# 用conv2d函數進行卷積操作,加上偏置

b_conv1 = bias_variable([32])

# 把x_image和權值向量進行卷積,加上偏置項,然后應用ReLU激活函數,

h_conv1 = tf.nn.relu(conv2d(x_image, W_conv1) + b_conv1)

# 對卷積的輸出結果進行池化操作

h_pool1 = max_pool_2x2(h_conv1)

# 第二層卷積(和第一層大致相同,卷積核為64,這一層卷積會提取64種特征)

W_conv2 = weight_variable([5, 5, 32, 64])

b_conv2 = bias_variable([64])

h_conv2 = tf.nn.relu(conv2d(h_pool1, W_conv2) + b_conv2)

h_pool2 = max_pool_2x2(h_conv2)

# 全連接層。隱含節點數1024。使用ReLU激活函數

W_fc1 = weight_variable([7 * 7 * 64, 1024])

b_fc1 = bias_variable([1024])

h_pool2_flat = tf.reshape(h_pool2, [-1, 7*7*64])

h_fc1 = tf.nn.relu(tf.matmul(h_pool2_flat, W_fc1) + b_fc1)

# 為了防止過擬合,在輸出層之前加Dropout層

keep_prob = tf.placeholder(tf.float32)

h_fc1_drop = tf.nn.dropout(h_fc1, keep_prob)

# 輸出層。添加一個softmax層,就像softmax regression一樣。得到概率輸出。

W_fc2 = weight_variable([1024, 10])

b_fc2 = bias_variable([10])

y_conv=tf.nn.softmax(tf.matmul(h_fc1_drop, W_fc2) + b_fc2)

########模型訓練設置########

# 定義loss function為cross entropy,優化器使用Adam,并給予一個比較小的學習速率1e-4

cross_entropy = tf.reduce_mean(-tf.reduce_sum(y_*tf.log(y_conv),reduction_indices=[1]))

train_step = tf.train.AdamOptimizer(1e-4).minimize(cross_entropy)

# 定義評測準確率的操作

correct_prediction = tf.equal(tf.argmax(y_conv,1), tf.argmax(y_,1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

########開始訓練過程########

# 初始化所有參數

tf.global_variables_initializer().run()

# 訓練(設置訓練時Dropout的kepp_prob比率為0.5。mini-batch為50,進行2000次迭代訓練,參與訓練樣本5萬)

# 其中每進行100次訓練,對準確率進行一次評測keep_prob設置為1,用以實時監測模型的性能

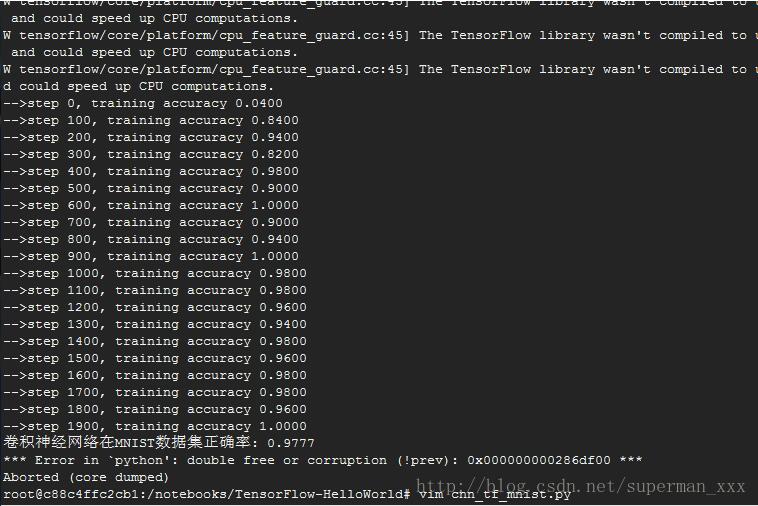

for i in range(1000):

batch = mnist.train.next_batch(50)

if i%100 == 0:

train_accuracy = accuracy.eval(feed_dict={x:batch[0], y_: batch[1], keep_prob: 1.0})

print "-->step %d, training accuracy %.4f"%(i, train_accuracy)

train_step.run(feed_dict={x: batch[0], y_: batch[1], keep_prob: 0.5})

# 全部訓練完成之后,在最終測試集上進行全面測試,得到整體的分類準確率

print "卷積神經網絡在MNIST數據集正確率: %g"%accuracy.eval(feed_dict={

x: mnist.test.images, y_: mnist.test.labels, keep_prob: 1.0})

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持億速云。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。