您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章給大家分享的是有關Python爬蟲框架scrapy如何實現downloader_middleware設置proxy代理功能的內容。小編覺得挺實用的,因此分享給大家做個參考,一起跟隨小編過來看看吧。

具體如下:

一、背景:

小編在爬蟲的時候肯定會遇到被封殺的情況,昨天爬了一個網站,剛開始是可以了,在settings的設置DEFAULT_REQUEST_HEADERS偽裝自己是chrome瀏覽器,剛開始是可以的,緊接著就被對方服務器封殺了。

代理:

代理,代理,一直覺得爬去網頁把爬去速度放慢一點就能基本避免被封殺,雖然可以使用selenium,但是這個坎必須要過,scrapy的代理其實設置起來很簡單。

注意,request.meta['proxy']=代理ip的API

middlewares.py

class HttpbinProxyMiddleware(object):

def process_request(self, request, spider):

pro_addr = requests.get('http://127.0.0.1:5000/get').text

request.meta['proxy'] = 'http://' + pro_addr

#request.meta['proxy'] = 'http://' + proxy_ip設置啟動上面我們寫的這個代理

settings.py

DOWNLOADER_MIDDLEWARES = {

'httpbin.middlewares.HttpbinProxyMiddleware': 543,

}spiders

httpbin_test.py

import scrapy class HttpbinTestSpider(scrapy.Spider): name = "httpbin_test" allowed_domains = ["httpbin.ort/get"] start_urls = ['http://httpbin.org/get'] def parse(self, response): print(response.text)

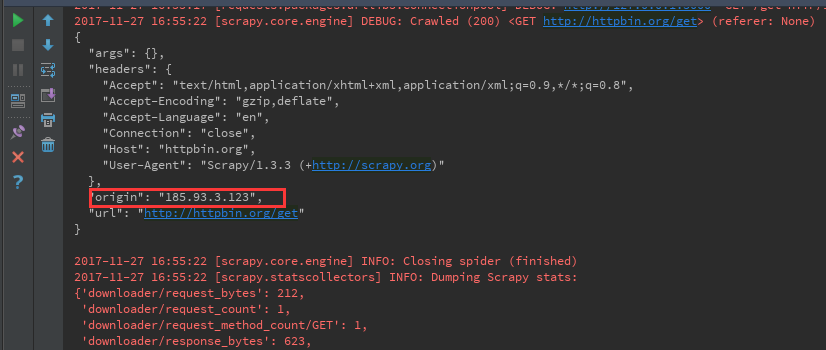

origin的值其實就是本地的公網地址,但是因為我們用了代理,這里的ip是美國的一個ip

二、那么問題來了,現在有這么一個場景,如上所述的話,我每個請求都會使用代理池里面的代理IP地址,但是有些操作是不需要代理IP地址的,那么怎么才能讓它請求超時的時候,再使用代理池的IP地址進行重新請求呢?

spider:

1、我們都知道scrapy的基本請求步驟是,首先執行父類里面(scrapy.Spider)里面的start_requests方法,

2、然后start_requests方法也是取拿我們設置的start_urls變量里面的url地址

3、最后才執行make_requests_from_url方法,并只傳入一個url變量

那么,我們就可以重寫make_requests_from_url方法,從而直接調用scrapy.Request()方法,我們簡單的了解一下里面的幾個參數:

1、url=url,其實就是最后start_requests()方法里面拿到的url地址

2、meta這里我們只設置了一個參數,download_timeout:10,作用就是當第一次發起請求的時候,等待10秒鐘,如果沒有請求成功的話,就會直接執行download_middleware里面的方法,我們下面介紹。

3、callback回調函數,其實就是本次的本次所有操作完成后執行的操作,注意,這里可不是說執行完上面所有操作后,再執行這個操作,比如說請求了一個url,并且成功了,下面就會執行這個方法。

4、dont_filter=False,這個很重要,有人說過不加的話默認就是False,但是親測必須得加,作用就是scrapy默認有去重的方法,等于False的話就意味著不參加scrapy的去重操作。親測,請求一個頁面,拿到第一個頁面后,抓取想要的操作后,第二頁就不行了,只有加上它才可以。

import scrapy

class HttpbinTestSpider(scrapy.Spider):

name = "httpbin_test"

allowed_domains = ["httpbin.ort/get"]

start_urls = ['http://httpbin.org/get']

def make_requests_from_url(self,url):

self.logger.debug('Try first time')

return scrapy.Request(url=url,meta={'download_timeout':10},callback=self.parse,dont_filter=False)

def parse(self, response):

print(response.text)middlewares.py

下面就是上面請求10秒后超時會執行的操作process_exception方法,心細的同學會發現,我們在spider文件里面輸出log的時候,是直接輸出的,那是因為scrapy早都在父類里面給你定義好了,直接應用就行,但是在middlewares里面需要自己定義一個類變量定義,才能使用引用。

class HttpbinProxyMiddleware(object):

logger = logging.getLogger(__name__)

# def process_request(self, request, spider):

# # pro_addr = requests.get('http://127.0.0.1:5000/get').text

# # request.meta['proxy'] = 'http://' + pro_addr

# pass

#

# def process_response(self, request, response, spider):

# # 可以拿到下載完的response內容,然后對下載完的內容進行修改(修改文本的編碼格式等操作)

# pass

def process_exception(self, request, response, spider):

self.logger.debug('Try Exception time')

self.logger.debug('Try second time')

proxy_addr = requests.get('http://127.0.0.1:5000/get').text

self.logger.debug(proxy_addr)

request.meta['proxy'] = 'http://{0}'.format(proxy_addr)settings.py

這里才是關鍵,我們需要執行middlewares里面的HttpbinProxyMiddleware類下面的方法,這里需要注意的是我取消了下載中間件的retry中間件,因為scrapy本身就有自動重試的方法,為了試驗效果,這里取消了默認的重試中間件。

DOWNLOADER_MIDDLEWARES = {

'httpbin.middlewares.HttpbinProxyMiddleware': 543,

#設置不參與scrapy的自動重試的動作

'scrapy.downloadermiddlewares.retry.RetryMiddleware':None

}注意:

上面我訪問的url是httpbin.org,這個網站不用代理也可以打開,這里你可以在不打開FQ工具的時候,訪問google.com,因為我自己學習用的代理地址基本都是國內的地址,所以即使是google也是打不開的。

總結:

上面我們介紹了兩種scrapy加代理的寫法:

1、第一種是直接每次訪問都使用代理IP發起請求

2、第二種是在不能正常獲取請求結果的時候,再使用代理ip。

3、我們學習了scrapy中如何打印logging日志,從而簡單判斷問題和執行步驟。

小知識:

['scrapy.downloadermiddlewares.httpauth.HttpAuthMiddleware', 'scrapy.downloadermiddlewares.downloadtimeout.DownloadTimeoutMiddleware', 'scrapy.downloadermiddlewares.defaultheaders.DefaultHeadersMiddleware', 'scrapy.downloadermiddlewares.useragent.UserAgentMiddleware', 'httpbin.middlewares.HttpbinProxyMiddleware', 'scrapy.downloadermiddlewares.redirect.MetaRefreshMiddleware', 'scrapy.downloadermiddlewares.httpcompression.HttpCompressionMiddleware', 'scrapy.downloadermiddlewares.redirect.RedirectMiddleware', 'scrapy.downloadermiddlewares.cookies.CookiesMiddleware', 'scrapy.downloadermiddlewares.stats.DownloaderStats'] 2017-11-27 23:36:47 [scrapy.middleware] INFO: Enabled spider middlewares: ['scrapy.spidermiddlewares.httperror.HttpErrorMiddleware', 'scrapy.spidermiddlewares.offsite.OffsiteMiddleware', 'scrapy.spidermiddlewares.referer.RefererMiddleware', 'scrapy.spidermiddlewares.urllength.UrlLengthMiddleware', 'scrapy.spidermiddlewares.depth.DepthMiddleware']

這里我們可以再Terminal下面打印一下,簡單介紹一下:

1、在scrapy中的中間件里面,對應的中間件后面的數字越小,執行優先級越高。

2、如果你想取消某個download_middlewares的話就直接如我上面寫的,把它Copy出來,加個None,這樣它就不執行了。

3、補充,如果你看過scrapy的基本執行流程圖的話,就會知道scrapy除了下載中間件,還有個spider中間件,所以用的時候不要用錯了。

D:\項目\小項目\scrapy_day6_httpbin\httpbin>scrapy settings --get=DOWNLOADER_MIDDLEWARES_BASE

{"scrapy.downloadermiddlewares.httpauth.HttpAuthMiddleware": 300, "scrapy.downloadermiddlewares.useragent.UserAgentMiddleware": 500, "scrapy.downloadermiddlewares.redirect.MetaRefres

hMiddleware": 580, "scrapy.downloadermiddlewares.httpcache.HttpCacheMiddleware": 900, "scrapy.downloadermiddlewares.redirect.RedirectMiddleware": 600, "scrapy.downloadermiddlewares.r

obotstxt.RobotsTxtMiddleware": 100, "scrapy.downloadermiddlewares.retry.RetryMiddleware": 550, "scrapy.downloadermiddlewares.cookies.CookiesMiddleware": 700, "scrapy.downloadermiddle

wares.defaultheaders.DefaultHeadersMiddleware": 400, "scrapy.downloadermiddlewares.stats.DownloaderStats": 850, "scrapy.downloadermiddlewares.httpcompression.HttpCompressionMiddlewar

e": 590, "scrapy.downloadermiddlewares.httpproxy.HttpProxyMiddleware": 750, "scrapy.downloadermiddlewares.downloadtimeout.DownloadTimeoutMiddleware": 350, "scrapy.downloadermiddlewar

es.ajaxcrawl.AjaxCrawlMiddleware": 560}感謝各位的閱讀!關于“Python爬蟲框架scrapy如何實現downloader_middleware設置proxy代理功能”這篇文章就分享到這里了,希望以上內容可以對大家有一定的幫助,讓大家可以學到更多知識,如果覺得文章不錯,可以把它分享出去讓更多的人看到吧!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。