溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

如何在Python3中使用Beautiful Soup?針對這個問題,這篇文章詳細介紹了相對應的分析和解答,希望可以幫助更多想解決這個問題的小伙伴找到更簡單易行的方法。

Beautiful Soup是一個可以從HTML或XML文件中提取數據的Python庫.它能夠通過你喜歡的轉換器實現慣用的文檔導航,查找,修改文檔的方式.

文檔中的例子其實說的已經比較清楚了,那下面就以爬取簡書首頁文章的標題一段代碼來演示一下:

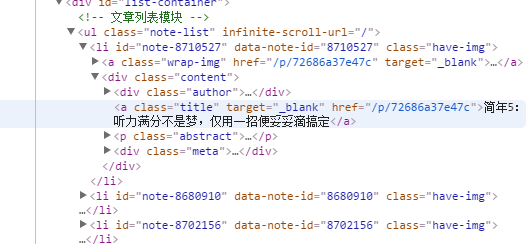

先來看簡書首頁的源代碼:

可以發現簡書首頁文章的標題都是在<a/>標簽中,并且class='title',所以,通過

find_all('a', 'title')便可獲得所有的文章標題,具體實現代碼及結果如下:

# -*- coding:utf-8 -*-

from urllib import request

from bs4 import BeautifulSoup

url = r'http://www.jianshu.com'

# 模擬真實瀏覽器進行訪問

headers = {'User-Agent':'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/55.0.2883.87 Safari/537.36'}

page = request.Request(url, headers=headers)

page_info = request.urlopen(page).read()

page_info = page_info.decode('utf-8')

# 將獲取到的內容轉換成BeautifulSoup格式,并將html.parser作為解析器

soup = BeautifulSoup(page_info, 'html.parser')

# 以格式化的形式打印html

# print(soup.prettify())

titles = soup.find_all('a', 'title') # 查找所有a標簽中class='title'的語句

# 打印查找到的每一個a標簽的string

for title in titles:

print(title.string)

PS:關于解析器

Beautiful Soup支持Python標準庫中的HTML解析器,還支持一些第三方的解析器,下表列出了主要的解析器,以及它們的優缺點:

| 解析器 | 使用方法 | 優勢 | 劣勢 |

|---|---|---|---|

| Python標準庫 | BeautifulSoup(markup, "html.parser") | (1)Python的內置標準庫 (2)執行速度適中 (3)文檔容錯能力強 | Python 2.7.3 or 3.2.2)前 的版本中文檔容錯能力差 |

| lxml HTML 解析器 | BeautifulSoup(markup, "lxml") | (1)速度快 (2)文檔容錯能力強 | 需要安裝C語言庫 |

| lxml XML 解析器 | BeautifulSoup(markup, ["lxml", "xml"]) OR BeautifulSoup(markup, "xml") | (1)速度快 (2)唯一支持XML的解析器 | 需要安裝C語言庫 |

| html5lib | BeautifulSoup(markup, "html5lib") | (1)最好的容錯性 (2)以瀏覽器的方式解析文檔 (3)生成HTML5格式的文檔 | (1)速度慢 (2)不依賴外部擴展 |

關于如何在Python3中使用Beautiful Soup問題的解答就分享到這里了,希望以上內容可以對大家有一定的幫助,如果你還有很多疑惑沒有解開,可以關注億速云行業資訊頻道了解更多相關知識。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。