您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

[TOC]

磁盤陣列(Redundant Arrays of Independent Drives,RAID),有“獨立磁盤構成的具有冗余能力的陣列”之意。

磁盤陣列是由很多塊獨立的磁盤,組合成一個容量巨大的磁盤組,利用個別磁盤提供數據所產生加成效果提升整個磁盤系統效能。利用這項技術,將數據切割成許多區段,分別存放在各個硬盤上。

磁盤陣列還能利用同位檢查(Parity Check)的觀念,在數組中任意一個硬盤故障時,仍可讀出數據,在數據重構時,將數據經計算后重新置入新硬盤中

常見的服務器硬件有:cpu,內存,網卡,硬盤,遠程管理口,陣列卡,電源,主板

cpu一般是雙芯的,即安裝兩個cpu

內存:支持內存容量很高,基本上都在4TB

硬盤:通常都會對硬盤做raid,來保證數據的高效傳輸和數據安全可靠

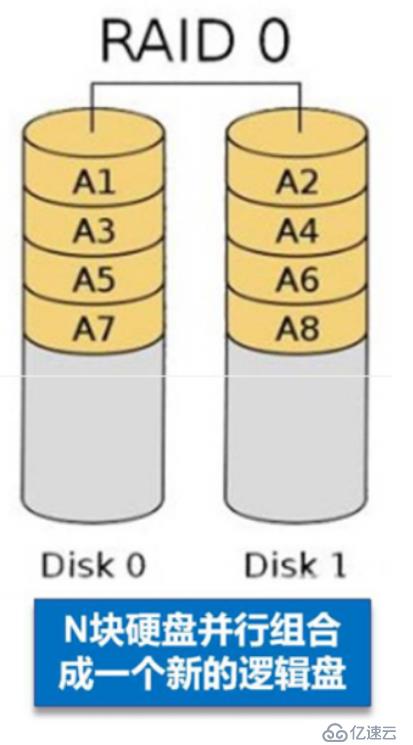

RAID 0連續以位或字節為單位分個數據,并行同時讀/寫于多個磁盤上,因此具有很高的數據傳輸率,但他沒有數據冗余(即沒有備份),因此并不能算是真正的RAID結構

RAID 0只是單純地提高性能,并沒有為數據的可靠性提供保證,可靠性低而且其中的一個磁盤失效將影響到所有數據

RAID 0不能應用于數據安全性要求高的場合,常應用于多讀寫的場景

RAID 0 在windows中叫做帶區卷(linux叫條帶券),

容量總和是兩個磁盤相加

?

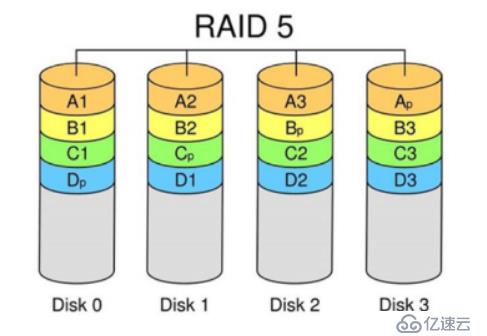

4)RAID 5磁盤陣列介紹

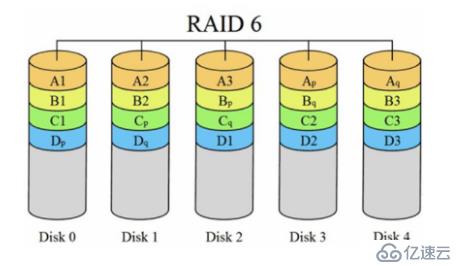

5)RAID 6磁盤陣列介紹

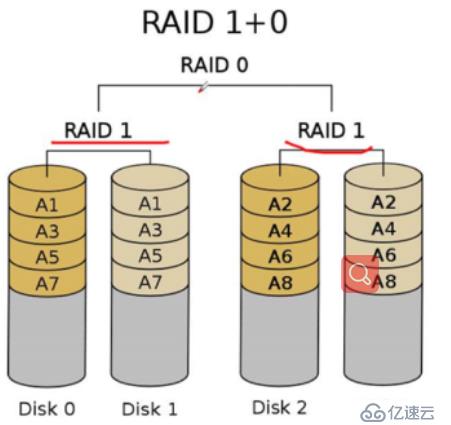

6) RAID 1+0磁盤陣列介紹

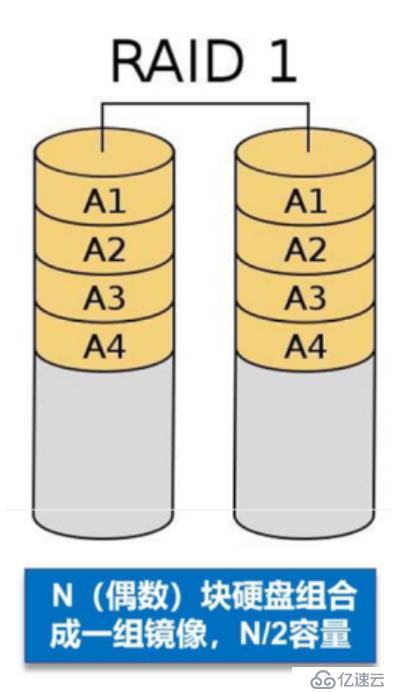

N(偶數,N>=4)塊盤兩兩鏡像后,再組合成一個RAID 0

陣列卡就是用來實現RAID功能的板卡,通常是由I/O(imput輸入/output輸出)處理器、硬盤控制器、硬盤連接器和緩存等一系列零組件構成的

不同的RAID卡支持的RAID功能不同,例如支持RAID0、RAID1、RAID5、RAID10等

RAID卡的接口類型

IDE接口、SCSI接口、SATA接口和SAS接口

緩存(Csche)是RAID卡與外部總線交換數據的場所,RAID卡先將數據傳送到緩存,在由緩存和外邊數據總線交換數據

緩存的大小與速度是直接關系到RAID卡的實際傳輸速度的重要因素

不同的RAID卡出廠時配備的內存容量不同,一半為幾兆到數百兆容量不等

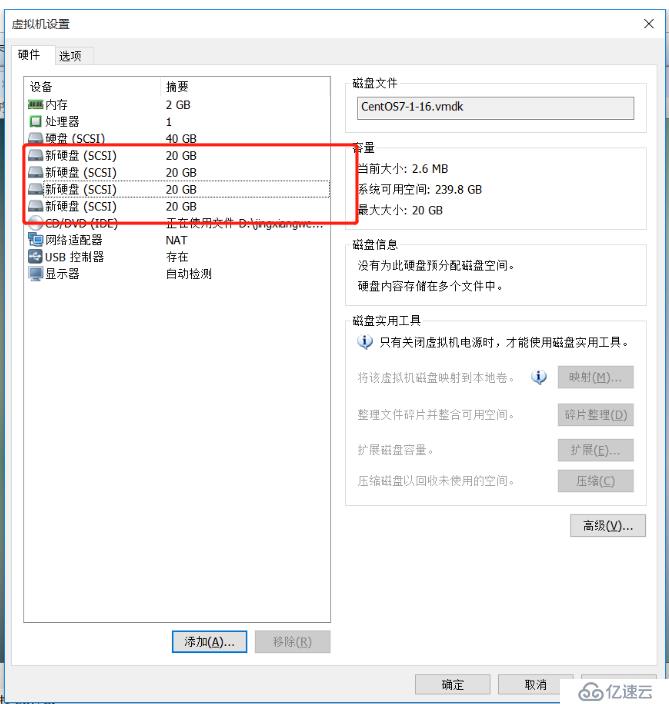

需求描述:

思路:

[root@localhost ~]# rpm -q mdadm 查看madadam工具是否已安裝

mdadm-4.0-5.el7.x86_64 顯示安裝

接下來開始配置硬盤

當前磁盤情況

[root@localhost ~]# fdisk -l 查看所有磁盤信息

磁盤 /dev/sda:42.9 GB, 42949672960 字節,83886080 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤標簽類型:dos

磁盤標識符:0x000a55e9

設備 Boot Start End Blocks Id System

/dev/sda1 * 2048 12584959 6291456 83 Linux

/dev/sda2 12584960 79710207 33562624 8e Linux LVM

磁盤 /dev/mapper/centos-root:21.5 GB, 21474836480 字節,41943040 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤 /dev/mapper/centos-swap:2147 MB, 2147483648 字節,4194304 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤 /dev/mapper/centos-home:10.7 GB, 10737418240 字節,20971520 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

[root@localhost ~]# init 6 重啟系統

[root@localhost ~]# fdisk -l 重新查看所有磁盤信息,發現新增的四塊磁盤

磁盤 /dev/sdb:21.5 GB, 21474836480 字節,41943040 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤 /dev/sdc:21.5 GB, 21474836480 字節,41943040 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤 /dev/sdd:21.5 GB, 21474836480 字節,41943040 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤 /dev/sde:21.5 GB, 21474836480 字節,41943040 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

開始依次給每塊磁盤進行分區

[root@localhost ~]# fdisk /dev/sdb 創建分區,

歡迎使用 fdisk (util-linux 2.23.2)。

更改將停留在內存中,直到您決定將更改寫入磁盤。

使用寫入命令前請三思。

Device does not contain a recognized partition table

使用磁盤標識符 0x2ed1de1d 創建新的 DOS 磁盤標簽。

命令(輸入 m 獲取幫助):n

Partition type:

p primary (0 primary, 0 extended, 4 free)

e extended

Select (default p):

Using default response p

分區號 (1-4,默認 1):

起始 扇區 (2048-41943039,默認為 2048):

將使用默認值 2048

Last 扇區, +扇區 or +size{K,M,G} (2048-41943039,默認為 41943039):

將使用默認值 41943039

分區 1 已設置為 Linux 類型,大小設為 20 GiB

命令(輸入 m 獲取幫助):t

已選擇分區 1

Hex 代碼(輸入 L 列出所有代碼):l

0 空 24 NEC DOS 81 Minix / 舊 Linu bf Solaris

1 FAT12 27 隱藏的 NTFS Win 82 Linux 交換 / So c1 DRDOS/sec (FAT-

2 XENIX root 39 Plan 9 83 Linux c4 DRDOS/sec (FAT-

3 XENIX usr 3c PartitionMagic 84 OS/2 隱藏的 C: c6 DRDOS/sec (FAT-

4 FAT16 <32M 40 Venix 80286 85 Linux 擴展 c7 Syrinx

5 擴展 41 PPC PReP Boot 86 NTFS 卷集 da 非文件系統數據

6 FAT16 42 SFS 87 NTFS 卷集 db CP/M / CTOS / .

7 HPFS/NTFS/exFAT 4d QNX4.x 88 Linux 純文本 de Dell 工具

8 AIX 4e QNX4.x 第2部分 8e Linux LVM df BootIt

9 AIX 可啟動 4f QNX4.x 第3部分 93 Amoeba e1 DOS 訪問

a OS/2 啟動管理器 50 OnTrack DM 94 Amoeba BBT e3 DOS R/O

b W95 FAT32 51 OnTrack DM6 Aux 9f BSD/OS e4 SpeedStor

c W95 FAT32 (LBA) 52 CP/M a0 IBM Thinkpad 休 eb BeOS fs

e W95 FAT16 (LBA) 53 OnTrack DM6 Aux a5 FreeBSD ee GPT

f W95 擴展 (LBA) 54 OnTrackDM6 a6 OpenBSD ef EFI (FAT-12/16/

10 OPUS 55 EZ-Drive a7 NeXTSTEP f0 Linux/PA-RISC

11 隱藏的 FAT12 56 Golden Bow a8 Darwin UFS f1 SpeedStor

12 Compaq 診斷 5c Priam Edisk a9 NetBSD f4 SpeedStor

14 隱藏的 FAT16 <3 61 SpeedStor ab Darwin 啟動 f2 DOS 次要

16 隱藏的 FAT16 63 GNU HURD or Sys af HFS / HFS+ fb VMware VMFS

17 隱藏的 HPFS/NTF 64 Novell Netware b7 BSDI fs fc VMware VMKCORE

18 AST 智能睡眠 65 Novell Netware b8 BSDI swap fd Linux raid 自動

1b 隱藏的 W95 FAT3 70 DiskSecure 多啟 bb Boot Wizard 隱 fe LANstep

1c 隱藏的 W95 FAT3 75 PC/IX be Solaris 啟動 ff BBT

1e 隱藏的 W95 FAT1 80 舊 Minix

Hex 代碼(輸入 L 列出所有代碼):fd

已將分區“Linux”的類型更改為“Linux raid autodetect”

命令(輸入 m 獲取幫助):p

磁盤 /dev/sdb:21.5 GB, 21474836480 字節,41943040 個扇區

Units = 扇區 of 1 * 512 = 512 bytes

扇區大小(邏輯/物理):512 字節 / 512 字節

I/O 大小(最小/最佳):512 字節 / 512 字節

磁盤標簽類型:dos

磁盤標識符:0x2ed1de1d

設備 Boot Start End Blocks Id System

/dev/sdb1 2048 41943039 20970496 fd Linux raid autodetect

命令(輸入 m 獲取幫助):w

The partition table has been altered!

Calling ioctl() to re-read partition table.

正在同步磁盤。

用fdisk /dev/sdc,fidsk /dev/sdd,fdisk /dev/sde命令去配置另外三塊磁盤,

設備 Boot Start End Blocks Id System

/dev/sdc1 2048 41943039 20970496 fd Linux raid autodetect

設備 Boot Start End Blocks Id System

/dev/sdd1 2048 41943039 20970496 fd Linux raid autodetect

設備 Boot Start End Blocks Id System

/dev/sde1 2048 41943039 20970496 fd Linux raid autodetect

接下來就可以以這四塊磁盤為素材,去配置raid,先配置個raid

可以先試一下raid0條帶卷,也叫做跨區卷

[root@localhost ~]# mdadm -C -v /dev/md0 -l0 -n2 /dev/sd[b-c]1

#/dev/md0就是raid0名字,-C 創建,-v顯示過程 -l確定raid等級,-n確定幾塊盤,

還有一個備用選項-x

mdadm: chunk size defaults to 512K

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md0 started.

[root@localhost ~]# mdadm -D /dev/md0 #mdadm -D 顯示raid信息

/dev/md0:

Version : 1.2

Creation Time : Mon Nov 4 12:49:59 2019

Raid Level : raid0

Array Size : 41908224 (39.97 GiB 42.91 GB)

Raid Devices : 2

Total Devices : 2

Persistence : Superblock is persistent

Update Time : Mon Nov 4 12:49:59 2019

State : clean

Active Devices : 2

Working Devices : 2

Failed Devices : 0

Spare Devices : 0

Chunk Size : 512K

Consistency Policy : none

Name : localhost.localdomain:0 (local to host localhost.localdomain)

UUID : d531230c:c4e71b72:00f695a1:f9ce404c

Events : 0

Number Major Minor RaidDevice State

0 8 17 0 active sync /dev/sdb1

1 8 33 1 active sync /dev/sdc1

[root@localhost ~]# cat /proc/mdstat #還可以從/proc硬件信息目錄中查看

raid對應的文件/proc/mdstat

Personalities : [raid0]

md0 : active raid0 sdc1[1] sdb1[0]

41908224 blocks super 1.2 512k chunks

raid0 卷制作完畢,接下來格式化之后就可以掛載使用

[root@localhost ~]# mkfs.xfs /dev/md0 #格式化/dev/md0

meta-data=/dev/md0 isize=512 agcount=16, agsize=654720 blks

= sectsz=512 attr=2, projid32bit=1

= crc=1 finobt=0, sparse=0

data = bsize=4096 blocks=10475520, imaxpct=25

= sunit=128 swidth=256 blks

naming =version 2 bsize=4096 ascii-ci=0 ftype=1

log =internal log bsize=4096 blocks=5120, version=2

= sectsz=512 sunit=8 blks, lazy-count=1

realtime =none extsz=4096 blocks=0, rtextents=0

[root@localhost ~]# mkdir /md0 #創建掛載點目錄

[root@localhost ~]# mount /dev/md0 /md0 #掛載

[root@localhost ~]# df -Th #查看

文件系統 類型 容量 已用 可用 已用% 掛載點

/dev/mapper/centos-root xfs 20G 3.3G 17G 17% /

devtmpfs devtmpfs 977M 0 977M 0% /dev

tmpfs tmpfs 993M 0 993M 0% /dev/shm

tmpfs tmpfs 993M 9.0M 984M 1% /run

tmpfs tmpfs 993M 0 993M 0% /sys/fs/cgroup

/dev/sda1 xfs 6.0G 161M 5.9G 3% /boot

/dev/mapper/centos-home xfs 10G 50M 10G 1% /home

tmpfs tmpfs 199M 12K 199M 1% /run/user/42

tmpfs tmpfs 199M 0 199M 0% /run/user/0

/dev/md0 xfs 40G 33M 40G 1% /md0 #已掛載

接下來取消掛載,停止md0

[root@localhost dev]# umount /md0

[root@localhost dev]# mdadm --stop /dev/md0

mdadm: stopped /dev/md0

[root@localhost dev]# cat /proc/mdstat

Personalities : [raid0]

unused devices: <none>

[root@localhost dev]# ls 查看發現沒有md0

agpgart log sdc tty18 tty45 urandom

autofs loop-control sdc1 tty19 tty46 usbmon0

block lp0 sdd tty2 tty47 usbmon1

bsg lp1 sdd1 tty20 tty48 usbmon2

btrfs-control lp2 sde tty21 tty49 vcs

bus lp3 sde1 tty22 tty5 vcs1

cdrom mapper sg0 tty23 tty50 vcs2

centos mcelog sg1 tty24 tty51 vcs3

char mem sg2 tty25 tty52 vcs4

console mqueue sg3 tty26 tty53 vcs5

core net sg4 tty27 tty54 vcs6

cpu network_latency sg5 tty28 tty55 vcsa

cpu_dma_latency network_throughput shm tty29 tty56 vcsa1

crash null snapshot tty3 tty57 vcsa2

disk nvram snd tty30 tty58 vcsa3

dm-0 oldmem sr0 tty31 tty59 vcsa4

dm-1 port stderr tty32 tty6 vcsa5

dm-2 ppp stdin tty33 tty60 vcsa6

dri ptmx stdout tty34 tty61 vfio

fb0 pts tty tty35 tty62 vga_arbiter

fd random tty0 tty36 tty63 vhci

full raw tty1 tty37 tty7 vhost-net

fuse rfkill tty10 tty38 tty8 vmci

hidraw0 rtc tty11 tty39 tty9 vsock

hpet rtc0 tty12 tty4 ttyS0 zero

hugepages sda tty13 tty40 ttyS1

hwrng sda1 tty14 tty41 ttyS2

initctl sda2 tty15 tty42 ttyS3

input sdb tty16 tty43 uhid

kmsg sdb1 tty17 tty44 uinput

開始制作raid1,rai1d俗稱鏡像卷

[root@localhost dev]# mdadm -C -v /dev/md1 -l1 -n2 /dev/sd[b-c]1

#-C創建 -v顯示詳細過程 要創建的raid名稱 -l raid等級 -n磁盤個數 磁盤名稱

mdadm: /dev/sdb1 appears to be part of a raid array:

level=raid0 devices=2 ctime=Mon Nov 4 12:49:59 2019

mdadm: Note: this array has metadata at the start and

may not be suitable as a boot device. If you plan to

store '/boot' on this device please ensure that

your boot-loader understands md/v1.x metadata, or use

--metadata=0.90

mdadm: /dev/sdc1 appears to be part of a raid array:

level=raid0 devices=2 ctime=Mon Nov 4 12:49:59 2019

mdadm: size set to 20954112K

Continue creating array? y

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md1 started.

[root@localhost dev]# cat /proc/mdstat 查看mdstat狀態

Personalities : [raid0] [raid1]

md1 : active raid1 sdc1[1] sdb1[0]

20954112 blocks super 1.2 [2/2] [UU]

[=====>...............] resync = 26.7% (5601408/20954112) finish=1.2min speed=207459K/sec #正在同步

unused devices: <none>

[root@localhost dev]# mdadm -D /dev/md1 #查看詳細信息

/dev/md1:

Version : 1.2

Creation Time : Mon Nov 4 13:41:55 2019

Raid Level : raid1

Array Size : 20954112 (19.98 GiB 21.46 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 2

Total Devices : 2

Persistence : Superblock is persistent

Update Time : Mon Nov 4 13:43:39 2019

State : clean

Active Devices : 2

Working Devices : 2

Failed Devices : 0

Spare Devices : 0

Consistency Policy : resync

Name : localhost.localdomain:1 (local to host localhost.localdomain)

UUID : d873e511:0bb8274c:97a98d9f:76313fc8

Events : 17

Number Major Minor RaidDevice State

0 8 17 0 active sync /dev/sdb1

1 8 33 1 active sync /dev/sdc1

[root@localhost dev]# mkfs.xfs /dev/md1 #格式化/dev/md1

mkfs.xfs: /dev/md1 appears to contain an existing filesystem (xfs).

mkfs.xfs: Use the -f option to force overwrite.

#反饋說md1中存在xfs系統,是否要強行執行-f格式化,原因自己分析一波,我就不解釋了

[root@localhost dev]# mkfs.xfs -f /dev/md1 #強制執行

meta-data=/dev/md1 isize=512 agcount=4, agsize=1309632 blks

= sectsz=512 attr=2, projid32bit=1

= crc=1 finobt=0, sparse=0

data = bsize=4096 blocks=5238528, imaxpct=25

= sunit=0 swidth=0 blks

naming =version 2 bsize=4096 ascii-ci=0 ftype=1

log =internal log bsize=4096 blocks=2560, version=2

= sectsz=512 sunit=0 blks, lazy-count=1

realtime =none extsz=4096 blocks=0, rtextents=0

[root@localhost dev]# mount /dev/md1 /md0 #掛載到之前設置的掛載點/md0

[root@localhost dev]# df -Th

文件系統 類型 容量 已用 可用 已用% 掛載點

/dev/mapper/centos-root xfs 20G 3.3G 17G 17% /

devtmpfs devtmpfs 977M 0 977M 0% /dev

tmpfs tmpfs 993M 0 993M 0% /dev/shm

tmpfs tmpfs 993M 9.0M 984M 1% /run

tmpfs tmpfs 993M 0 993M 0% /sys/fs/cgroup

/dev/sda1 xfs 6.0G 161M 5.9G 3% /boot

/dev/mapper/centos-home xfs 10G 50M 10G 1% /home

tmpfs tmpfs 199M 12K 199M 1% /run/user/42

tmpfs tmpfs 199M 0 199M 0% /run/user/0

/dev/md1 xfs 20G 33M 20G 1% /md0

還有-x 指定備用磁盤,這里操作演示一波

[root@localhost dev]# umount /md0 取消掛載

[root@localhost dev]# mdadm -S /dev/md1 停止raid1

mdadm: stopped /dev/md1

[root@localhost dev]# mdadm -C /dev/md2 -l1 -n2 /dev/sd[d-e]1 -x1 /dev/sdb1

#重新創建一個raid1,-x1,指定一塊備用磁盤

mdadm: Note: this array has metadata at the start and

may not be suitable as a boot device. If you plan to

store '/boot' on this device please ensure that

your boot-loader understands md/v1.x metadata, or use

--metadata=0.90

mdadm: /dev/sdb1 appears to be part of a raid array:

level=raid1 devices=2 ctime=Mon Nov 4 13:41:55 2019

Continue creating array? y

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md2 started.

[root@localhost dev]# cat /proc/mdstat #查看信息狀態

Personalities : [raid0] [raid1]

md2 : active raid1 sdb1[2](S) sde1[1] sdd1[0]

20954112 blocks super 1.2 [2/2] [UU]

[====>................] resync = 21.0% (4400896/20954112) finish=1.3min speed=209566K/sec

unused devices: <none>

[root@localhost dev]# mdadm -D /dev/md2 #第二種方法查看

/dev/md2:

Version : 1.2

Creation Time : Mon Nov 4 14:27:51 2019

Raid Level : raid1

Array Size : 20954112 (19.98 GiB 21.46 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 2

Total Devices : 3

Persistence : Superblock is persistent

Update Time : Mon Nov 4 14:28:49 2019

State : clean, resyncing

Active Devices : 2

Working Devices : 3

Failed Devices : 0

Spare Devices : 1

Consistency Policy : resync

Resync Status : 56% complete

Name : localhost.localdomain:2 (local to host localhost.localdomain)

UUID : 774b6bee:46ab3939:243f63b7:fdc1d58d

Events : 9

Number Major Minor RaidDevice State

0 8 49 0 active sync /dev/sdd1

1 8 65 1 active sync /dev/sde1

2 8 17 - spare /dev/sdb1 #這一塊就是備用盤

用mdadm中的-f去模擬演示毀掉一塊盤

[root@localhost dev]# mdadm -f /dev/md2 /dev/sdd1 毀掉md2中的sdd1

mdadm: set /dev/sdd1 faulty in /dev/md2

[root@localhost dev]# mdadm -D /dev/md2

/dev/md2:

Version : 1.2

Creation Time : Mon Nov 4 14:27:51 2019

Raid Level : raid1

Array Size : 20954112 (19.98 GiB 21.46 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 2

Total Devices : 3

Persistence : Superblock is persistent

Update Time : Mon Nov 4 14:30:11 2019

State : clean, degraded, recovering

Active Devices : 1

Working Devices : 2

Failed Devices : 1

Spare Devices : 1

Consistency Policy : resync

Rebuild Status : 15% complete

Name : localhost.localdomain:2 (local to host localhost.localdomain)

UUID : 774b6bee:46ab3939:243f63b7:fdc1d58d

Events : 21

Number Major Minor RaidDevice State

2 8 17 0 spare rebuilding /dev/sdb1 #被頂替上去

1 8 65 1 active sync /dev/sde1

0 8 49 - faulty /dev/sdd1 #被換下來

再實驗一個raid5,從案例的需求可以發現,可以為其配置raid6,或者raid1+0,這里還是先順序把raid5演練一波

[root@localhost dev]# mdadm -S /dev/md2 #停止md2

mdadm: stopped /dev/md2

[root@localhost dev]# mdadm -C -v /dev/md5 -l5 -n3 /dev/sd[b-d]1 -x1 /dev/sde1

#-C創建 -v顯示詳細過程 raid名稱 -l raid等級 -n 組成raid磁盤個數 組成raid的磁盤名稱

-x 備用磁盤

mdadm: layout defaults to left-symmetric

mdadm: layout defaults to left-symmetric

mdadm: chunk size defaults to 512K

mdadm: /dev/sdb1 appears to be part of a raid array:

level=raid1 devices=2 ctime=Mon Nov 4 14:27:51 2019

mdadm: /dev/sdc1 appears to be part of a raid array:

level=raid1 devices=2 ctime=Mon Nov 4 13:41:55 2019

mdadm: /dev/sdd1 appears to be part of a raid array:

level=raid1 devices=2 ctime=Mon Nov 4 14:27:51 2019

mdadm: /dev/sde1 appears to be part of a raid array:

level=raid1 devices=2 ctime=Mon Nov 4 14:27:51 2019

mdadm: size set to 20954112K

Continue creating array? y

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md5 started.

[root@localhost dev]# mdadm -D /dev/md5

/dev/md5:

Version : 1.2

Creation Time : Mon Nov 4 14:57:07 2019

Raid Level : raid5

Array Size : 41908224 (39.97 GiB 42.91 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 3

Total Devices : 4

Persistence : Superblock is persistent

Update Time : Mon Nov 4 14:58:53 2019

State : clean

Active Devices : 3

Working Devices : 4

Failed Devices : 0

Spare Devices : 1

Layout : left-symmetric

Chunk Size : 512K

Consistency Policy : resync

Name : localhost.localdomain:5 (local to host localhost.localdomain)

UUID : 6057b886:24586340:b6ece802:6f3904d6

Events : 18

Number Major Minor RaidDevice State

0 8 17 0 active sync /dev/sdb1

1 8 33 1 active sync /dev/sdc1

4 8 49 2 active sync /dev/sdd1

3 8 65 - spare /dev/sde1

-x備用了一塊磁盤,這里搞壞一個盤試一試

[root@localhost dev]# mdadm -f /dev/md5 /dev/sdd1 #搞壞md5下面的sdd1

mdadm: set /dev/sdd1 faulty in /dev/md5 #顯示成功搞壞

[root@localhost dev]# mdadm -D /dev/md5 #再次查看信息

/dev/md5:

Version : 1.2

Creation Time : Mon Nov 4 14:57:07 2019

Raid Level : raid5

Array Size : 41908224 (39.97 GiB 42.91 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 3

Total Devices : 4

Persistence : Superblock is persistent

Update Time : Mon Nov 4 15:04:50 2019

State : clean, degraded, recovering

Active Devices : 2

Working Devices : 3

Failed Devices : 1

Spare Devices : 1

Layout : left-symmetric

Chunk Size : 512K

Consistency Policy : resync

Rebuild Status : 25% complete

Name : localhost.localdomain:5 (local to host localhost.localdomain)

UUID : 6057b886:24586340:b6ece802:6f3904d6

Events : 24

Number Major Minor RaidDevice State

0 8 17 0 active sync /dev/sdb1

1 8 33 1 active sync /dev/sdc1

3 8 65 2 spare rebuilding /dev/sde1 #頂替上來

4 8 49 - faulty /dev/sdd1 #換下來

然后的操作就是格式化,mkfs.xfs /dev/md5,掛載,這里就不再操作了

raid6就是把其中的級別-l改為6,磁盤塊數-n不少于四塊,備用盤-x記得給,養成好習慣,在演示一波raid1+0

raid1+0的原理是先用兩塊盤去做raid1鏡像卷,然后把兩個raid1為單位,去做raid0條帶卷

[root@localhost dev]# mdadm -S /dev/md5 #停用md5

mdadm: stopped /dev/md5

[root@localhost dev]# mdadm -C -v /dev/md1 -l1 -n2 /dev/sd[b-c]1 #創建raid1 md1

mdadm: /dev/sdb1 appears to be part of a raid array:

level=raid5 devices=3 ctime=Mon Nov 4 14:57:07 2019

mdadm: Note: this array has metadata at the start and

may not be suitable as a boot device. If you plan to

store '/boot' on this device please ensure that

your boot-loader understands md/v1.x metadata, or use

--metadata=0.90

mdadm: /dev/sdc1 appears to be part of a raid array:

level=raid5 devices=3 ctime=Mon Nov 4 14:57:07 2019

mdadm: size set to 20954112K

Continue creating array? y

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md1 started.

[root@localhost dev]# mdadm -C -v /dev/md2 -l1 -n2 /dev/sd[d-e]1 #創建riad1 md2

mdadm: /dev/sdd1 appears to be part of a raid array:

level=raid5 devices=3 ctime=Mon Nov 4 14:57:07 2019

mdadm: Note: this array has metadata at the start and

may not be suitable as a boot device. If you plan to

store '/boot' on this device please ensure that

your boot-loader understands md/v1.x metadata, or use

--metadata=0.90

mdadm: /dev/sde1 appears to be part of a raid array:

level=raid5 devices=3 ctime=Mon Nov 4 14:57:07 2019

mdadm: size set to 20954112K

Continue creating array? y

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md2 started.

[root@localhost dev]# mdadm -C -v /dev/md0 -l0 -n2 /dev/md[1-2] #以兩個鏡像卷為

單位,創建raid0

mdadm: chunk size defaults to 512K

mdadm: Defaulting to version 1.2 metadata

mdadm: array /dev/md0 started.

[root@localhost dev]# mdadm -D /dev/md0 #查看raid0卷md0

/dev/md0:

Version : 1.2

Creation Time : Mon Nov 4 15:19:28 2019

Raid Level : raid0

Array Size : 41875456 (39.94 GiB 42.88 GB)

Raid Devices : 2

Total Devices : 2

Persistence : Superblock is persistent

Update Time : Mon Nov 4 15:19:28 2019

State : clean

Active Devices : 2

Working Devices : 2

Failed Devices : 0

Spare Devices : 0

Chunk Size : 512K

Consistency Policy : none

Name : localhost.localdomain:0 (local to host localhost.localdomain)

UUID : e0b393ab:3c8c8d1c:21ddf9f1:26ab1901

Events : 0

Number Major Minor RaidDevice State

0 9 1 0 active sync /dev/md1 #單位是鏡像卷

1 9 2 1 active sync /dev/md2

[root@localhost dev]# mdadm -D /dev/md1 #查看raid1卷md1

/dev/md1:

Version : 1.2

Creation Time : Mon Nov 4 15:18:02 2019

Raid Level : raid1

Array Size : 20954112 (19.98 GiB 21.46 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 2

Total Devices : 2

Persistence : Superblock is persistent

Update Time : Mon Nov 4 15:19:47 2019

State : active

Active Devices : 2

Working Devices : 2

Failed Devices : 0

Spare Devices : 0

Consistency Policy : resync

Name : localhost.localdomain:1 (local to host localhost.localdomain)

UUID : 8ece5682:dc5b03c7:5d1d67a8:22c85b59

Events : 18

Number Major Minor RaidDevice State

0 8 17 0 active sync /dev/sdb1 #單位是sd

1 8 33 1 active sync /dev/sdc1

[root@localhost dev]# mdadm -D /dev/md2

/dev/md2:

Version : 1.2

Creation Time : Mon Nov 4 15:18:43 2019

Raid Level : raid1

Array Size : 20954112 (19.98 GiB 21.46 GB)

Used Dev Size : 20954112 (19.98 GiB 21.46 GB)

Raid Devices : 2

Total Devices : 2

Persistence : Superblock is persistent

Update Time : Mon Nov 4 15:20:02 2019

State : active, resyncing

Active Devices : 2

Working Devices : 2

Failed Devices : 0

Spare Devices : 0

Consistency Policy : resync

Resync Status : 79% complete

Name : localhost.localdomain:2 (local to host localhost.localdomain)

UUID : 9501fa59:f37e90a0:227aaf3f:567026a1

Events : 13

Number Major Minor RaidDevice State

0 8 49 0 active sync /dev/sdd1

1 8 65 1 active sync /dev/sde1

[root@localhost dev]# mount /dev/md1 /md0 #掛載raid1鏡像卷

mount: 未知的文件系統類型“linux_raid_member” #沒有格式化

[root@localhost dev]# mount /dev/md0 /md0 #掛載raid0條帶卷

mount: /dev/md0 寫保護,將以只讀方式掛載 #可以掛,但是沒啥用,只讀,寫保護

mount: 未知的文件系統類型“(null)”

[root@localhost dev]# mkfs.xfs /dev/md0 #格式化條帶卷raid0

meta-data=/dev/md0 isize=512 agcount=16, agsize=654208 blks

= sectsz=512 attr=2, projid32bit=1

= crc=1 finobt=0, sparse=0

data = bsize=4096 blocks=10467328, imaxpct=25

= sunit=128 swidth=256 blks

naming =version 2 bsize=4096 ascii-ci=0 ftype=1

log =internal log bsize=4096 blocks=5112, version=2

= sectsz=512 sunit=8 blks, lazy-count=1

realtime =none extsz=4096 blocks=0, rtextents=0

[root@localhost dev]# mount /dev/md0 /md0 #再次掛載raid0,可以正常掛上去

[root@localhost dev]# mkfs.xfs /dev/md1 #格式化鏡像卷raid1,發現資源忙

mkfs.xfs: cannot open /dev/md1: 設備或資源忙 #這是因為鏡像卷成為raid0的單位,

無法執行獨立的操作

[root@localhost dev]# df -TH #查看一下

文件系統 類型 容量 已用 可用 已用% 掛載點

/dev/mapper/centos-root xfs 22G 3.5G 18G 17% /

devtmpfs devtmpfs 1.1G 0 1.1G 0% /dev

tmpfs tmpfs 1.1G 0 1.1G 0% /dev/shm

tmpfs tmpfs 1.1G 9.5M 1.1G 1% /run

tmpfs tmpfs 1.1G 0 1.1G 0% /sys/fs/cgroup

/dev/sda1 xfs 6.5G 168M 6.3G 3% /boot

/dev/mapper/centos-home xfs 11G 52M 11G 1% /home

tmpfs tmpfs 209M 13k 209M 1% /run/user/42

tmpfs tmpfs 209M 0 209M 0% /run/user/0

/dev/md0 xfs 43G 35M 43G 1% /md0 #掛載成功

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。